トレンドまとめ

Vibe Coding時代のAIエージェントOSS 7カテゴリ整理

12分で読める|2026/04/15|

AI開発ツールトレンドVibe Codingオープンソース

この記事の要約

Vibe Coding で出会うAIエージェントOSSは、同じ土俵の競合ではありません。multi-agent framework、eval/red team、design skill、context DB、simulation sandbox、model training harness、safety-bypass research tool という7カテゴリで整理し、導入前に見るべき論点をまとめます。

Vibe Coding 周辺では「今追うべき AI エージェント OSS 7 選」のような記事が増えています。ただ、実務で重要なのはどの repo が一番バズっているかではなく、その OSS が何の責務を持ち、どこまで production flow に入れてよいかです。

TheAgency、promptfoo、Impeccable、OpenViking、nanochat、Heretic のようなプロジェクトは、同じ「AI エージェントツール」という箱に入っていても役割がまったく違います。さらに、social simulation のように research 寄りで、日常開発の中心には置きにくいカテゴリもあります。

本記事では、Fireship の動画で話題になった周辺プロジェクト群を、そのまま「2026 年最新ランキング」として消費するのではなく、7 つのカテゴリに分けて整理します。各カテゴリについて、公式 README や docs で確認できる範囲の役割と、導入前に見るべき論点をまとめます。

この記事の前提

- 機能、対応モデル、課金、配布方法は変化が速いため、導入前に必ず各プロジェクトの current docs / README を確認してください

- 本記事は「どれが最強か」のランキングではなく、repo の役割とガバナンスを見分けるための整理です

- ガードレール除去や red team 系のツールは、技術的に可能でも、組織ポリシーや法務レビューを通した上で扱う必要があります

AI コーディング領域全体の product surface を見たい場合は、AIコーディングツール5カテゴリ比較 も参照してください。

この記事でわかること

- 7カテゴリの違い: multi-agent framework、eval/red team、design skill、context DB、simulation sandbox、model training harness、safety-bypass research tool は何が違うのか

- 導入前の判断軸: source of truth、評価、権限、法務、運用責任をどう見るべきか

- 現実的な導入順: どこから試し、どこを research 用に隔離すべきか

基本情報

| 項目 | 内容 |

|---|---|

| トピック | Vibe Coding 周辺の AI エージェント OSS |

| カテゴリ | トレンド / 技術解説 |

| 対象読者 | エンジニアリング責任者、AI 導入を検討する CTO、platform team |

| 読み方 | 「最新ツール紹介」ではなく、導入前の切り分け表として読む |

まず結論: 7カテゴリは同じ土俵にいない

最初に押さえたいのは、ここで扱う 7 カテゴリが同じ problem を解いているわけではないという点です。

| カテゴリ | 代表例 | README / docs で確認しやすい役割 | 導入前に見るべきこと |

|---|---|---|---|

| Multi-agent development framework | TheAgency | Claude Code 上で複数 agent、workstreams、knowledge、quality gate を運用する枠組み | repo 規約、handoff、human approval、作業分担 |

| Eval / red team | promptfoo | LLM app の評価、比較、red teaming、CI/CD 連携 | 評価データ、security review、CI への組み込み |

| Design skill / anti-pattern guard | Impeccable | frontend design 用の skill bundle と design anti-pattern の検出 | 既存 design system との相性、導入先ツール、レビュー責任 |

| Context database | OpenViking | memory / resources / skills を filesystem 的に扱う context 管理 | storage 設計、retrieval 可観測性、provider 依存、運用負荷 |

| Simulation sandbox | social simulation 系プロジェクト | 複数 agent に外部シグナルを渡して議論させる実験環境 | データ provenance、評価方法、言語対応、production との距離 |

| Model training harness | nanochat | tokenization から pretraining、finetuning、evaluation、chat UI までを含む実験基盤 | GPU 予算、学習データ、再現性、研究体制 |

| Safety-bypass research tool | Heretic | safety alignment / censorship removal を自動化する研究ツール | 組織ポリシー、法務、隔離環境、用途制限 |

この表からわかるように、TheAgency vs promptfoo や OpenViking vs nanochat は、置き換え関係ではありません。比較する前に、自分が欲しいのは orchestration なのか、evaluation なのか、memory なのか、research sandbox なのかを分ける必要があります。

先に答えるべき 5 つの質問

ツール名より先に、次の 5 問に答えると判断がぶれにくくなります。

1. 何を自動化したいのか

| 問い | 向きやすいカテゴリ |

|---|---|

| 複数の agent に役割分担させたい | TheAgency のような multi-agent framework |

| AI 出力を評価し、脆弱性を見つけたい | promptfoo のような eval / red team |

| 生成 UI の質を上げたい | Impeccable のような design skill |

| 長期記憶や context を整理したい | OpenViking のような context database |

| 独自モデルを育てたい | nanochat のような training harness |

2. source of truth はどこに置くのか

- repo と pull request を正本にするのか

- prompt / rules / knowledge file をどこで管理するのか

- context store を別で持つのか

- 実験結果や eval を CI に戻すのか

特に TheAgency や OpenViking のようなツールは、agent が何を参照し、何を学習済みの前提にするかをファイルや階層として管理します。ここが曖昧だと、agent 数を増やしても再現性が出ません。

3. production flow に入れるのか、research sandbox に留めるのか

この線引きは早めに決めるべきです。

- promptfoo は production flow に組み込みやすい

- Impeccable は design review の補助として入りやすい

- OpenViking は長期運用で効くが、導入はやや重い

- social simulation 系、nanochat、Heretic は research 寄りで、production の中心には置きにくい

4. 誰がレビュー責任を持つのか

導入の成否は「賢さ」より誰が承認するかで決まりやすいです。

- agent が作った diff を誰が見るか

- eval failure を誰が triage するか

- security / policy 例外を誰が許可するか

- model training の dataset と compute を誰が管理するか

5. 法務・ポリシー上の境界は明確か

特に red team、guardrail removal、独自モデル学習は、技術判断だけでは終わりません。

- 利用規約に反しないか

- 学習データやログの扱いが組織ルールに合うか

- 危険な出力をどう隔離するか

- 実験結果を production 環境へ持ち込む条件は何か

実務で試しやすい4カテゴリ

ここでは、比較的 production flow に近づけやすい 4 カテゴリを見ます。

1. TheAgency — multi-agent development framework

TheAgency の README は、Claude Code 上で複数 agent を動かし、agent knowledge、workstreams、principals、quality gates を持つconvention-over-configuration な multi-agent frameworkとして整理しています。

ここで重要なのは、「agent を増やせること」よりも、knowledge をどこに蓄積し、handoff をどう記録し、人間がどこで承認するかが先に定義されている点です。

向いている場面

- repo ごとの規約を agent に継続的に覚えさせたい

- 複数 task を役割分担させたい

- knowledge file や worklog を使って、session をまたいで学習を蓄積したい

先に確認したい論点

| 論点 | 見るべきこと |

|---|---|

| 役割分割 | 何人分の agent を置くかではなく、どの責務で切るか |

| handoff | 依頼・成果物・次 action をどこへ残すか |

| 品質 gate | tests / lint / review を agent 任せにしすぎないか |

| 人間の承認点 | commit、push、PR、deploy のどこで止めるか |

2. promptfoo — eval / red team

promptfoo の README では、LLM evals & red teaming を主目的にした CLI / library として整理されており、モデル比較、vulnerability scanning、CI/CD integration まで含めて運用できるようになっています。現在は OpenAI の一部ですが、README と company update では open source / MIT license は維持すると明記されています。

向いている場面

- prompt や model の変更を勘で決めたくない

- prompt injection や leakage のような脆弱性を継続的に見たい

- PR や CI に eval 結果を載せたい

先に確認したい論点

| 論点 | 見るべきこと |

|---|---|

| 評価軸 | 何を良い出力とみなすかが先に定義されているか |

| 失敗時の運用 | eval failure を誰が直すか |

| provider 差分 | model ごとに同じ prompt をそのまま比較してよいか |

| security scope | red team の対象をどこまで広げるか |

3. Impeccable — design skill / anti-pattern guard

Impeccable は README 上で、frontend design に特化した skill bundle と anti-pattern detector として説明されています。18 個の command と、typography / color / motion / responsive design などの reference を持つ構成です。

つまり Impeccable は runtime の agent platform ではなく、生成済みの UI をどの観点で直すかを AI に教える design skillと見るのが正確です。

向いている場面

- Vibe Coding で作った UI が似たり寄ったりになる

- 既存の design system に合わせた修正プロンプトを毎回書きたくない

- a11y、spacing、motion、copy をレビューの観点として揃えたい

先に確認したい論点

| 論点 | 見るべきこと |

|---|---|

| 正本 | Figma / design tokens / 実装済み CSS のどれを source of truth にするか |

| 対象ツール | Cursor、Claude Code、Codex などどこで使うか |

| 人手レビュー | 見た目の一貫性を誰が最終判断するか |

| 過剰修飾 | polish 系 command を production 要件より優先しすぎないか |

4. OpenViking — context database

OpenViking の README は、memory / resources / skills を viking:// の filesystem paradigm で扱う context database として整理しています。tiered context loading、recursive retrieval、visualized retrieval trajectory、automatic session management が中心概念です。

従来の「vector DB に全部入れる」より、agent が扱う context を階層化し、何をどの粒度で読み込んだかを追跡したいときに意味が出ます。

向いている場面

- 長く動く agent が context を食い散らかしている

- memory、docs、skills を別々に持っていて統一できていない

- retrieval の経路が見えず、なぜ誤答したか説明しにくい

先に確認したい論点

| 論点 | 見るべきこと |

|---|---|

| 導入コスト | provider、storage、server 運用を許容できるか |

| 境界 | 既存 RAG / vector DB とどう共存させるか |

| 可観測性 | retrieval log を誰が見るか |

| 長期運用 | session memory をどこまで自動で昇格させるか |

research 寄りで扱うべき3カテゴリ

ここからは、production の中心より研究や検証で隔離して扱う方が安全なカテゴリです。

5. Simulation sandbox — social simulation 系

このカテゴリは、外部データやニュース、イベントを複数 agent に渡して、議論や予測をさせるタイプの実験環境です。動画で取り上げられた例のように見た目は派手ですが、実務で必要なのは「賢そうに議論すること」ではなく、その出力をどう評価し、どこまで意思決定に使えるかです。

production に直結しにくい理由

- 外部データの provenance が曖昧になりやすい

- agent 間議論の見た目と、予測精度は別問題

- domain knowledge が強く必要で、汎用ツールとしては使いにくい

- docs や maintainer activity が薄いと評価しづらい

6. nanochat — model training harness

nanochat の README では、single GPU node で tokenization、pretraining、finetuning、evaluation、inference、chat UI まで扱える experimental harness として説明されています。これは「すぐ使える coding agent」というより、小型 LLM を自前で育てる研究基盤です。

向いている場面

- SLM の学習・評価を end-to-end で理解したい

- dataset、hyperparameter、hardware の関係を実験したい

- API 利用ではなく、自社で小規模モデル研究を回したい

先に確認したい論点

| 論点 | 見るべきこと |

|---|---|

| GPU 予算 | README の例は一例で、実コストは環境依存 |

| 学習データ | rights と quality を自分たちで持てるか |

| 再現性 | 研究メモと run 管理をどこまで残すか |

| 期待値 | hosted frontier model の代替ではなく、実験用ハーネスとして見るか |

7. Heretic — safety-bypass research tool

Heretic の README は、language model の censorship や safety alignment を automatic に除去する研究ツールとして書かれています。abliteration / directional ablation の最適化を自動化するもので、README 自体も research feature として位置づけています。

ここで重要なこと

このカテゴリは「強い agent を作る近道」ではありません。むしろ、production に安易に入れてはいけないカテゴリです。

- 組織ポリシーや法務と衝突しやすい

- 危険出力の封じ込め設計が必要

- 研究用途でも隔離環境とログ管理が必要

- 公開サービスや顧客向け導入の文脈では扱いが非常に重い

現実的な導入順はこの4段階

ランキングで消費するより、次の順で考えると失敗しにくくなります。

1. まず source of truth と役割分担を決める

repo、rules、knowledge file、PR review をどう回すかを決める段階です。ここでは TheAgency のような multi-agent framework の考え方が役立ちます。

2. 次に eval / red team を入れる

agent の autonomy を増やす前に、promptfoo のような評価基盤を先に入れた方が事故を減らせます。生成品質と安全性を測れないまま自動化だけ進めると、後で回収コストが跳ねます。

3. UI と context は、必要になった時点で足す

- 生成 UI の品質が問題なら Impeccable

- memory と retrieval が問題なら OpenViking

どちらも便利ですが、最初から全部載せる必要はありません。

4. research track は production track と分ける

nanochat や Heretic、social simulation 系は、実験として価値があっても production の主線とは別です。repo、権限、予算、レビュー責任を分けて運用した方が安全です。

よくある質問(FAQ)

Q1. promptfoo は OpenAI に加わった後も使えますか?

公式 README と company update では、OpenAI の一部になった後も open source / MIT license は維持すると案内されています。ただし、機能や商用プランの位置づけは変わりうるため、導入前に current docs を確認してください。

Q2. OpenViking はベクターDBの代わりになりますか?

完全な置き換えというより、agent が使う context を memory / resources / skills として整理する別レイヤーと見る方が正確です。既存 RAG と共存させる設計もあり得ます。

Q3. nanochat は安く自社LLMを作る近道ですか?

小型モデル研究の入口としては有力ですが、安い = 運用が簡単ではありません。GPU、データ、評価、再現性まで含めて回せる体制が必要です。

Q4. Heretic は agent の性能改善に使うべきですか?

一般的なプロダクト開発では推奨しません。研究用途でも、ポリシー、法務、隔離環境、ログ管理を前提に扱うカテゴリです。

Q5. まず何から試すのが現実的ですか?

多くのチームでは、repo 規約の明文化と eval / red team の整備から始めるのが現実的です。その後、必要に応じて design skill や context database を足すのが堅実です。

まとめ

Vibe Coding 周辺の OSS は、1 枚のランキング表に押し込むと判断を誤ります。TheAgency は orchestration、promptfoo は evaluation、Impeccable は design guard、OpenViking は context、nanochat は training、Heretic は research です。まずは何を自動化したいか、どこまで production に入れるかを分けて考えるべきです。

とくに durable な順で言えば、source of truth の整備 → eval / red team → 必要に応じた design / context 補強 → research の隔離という順で見ると、流行語に振り回されにくくなります。

関連記事

参考リソース

- Fireship: code report - 7 new AI agent tools you need to know about

- TheAgency Starter - GitHub

- promptfoo - GitHub

- promptfoo joining OpenAI

- Impeccable - GitHub

- OpenViking - GitHub

- nanochat - GitHub

- Heretic - GitHub

本記事はネクサフローのAIトレンドシリーズの一部です。

この記事の著者

中村 知良

代表取締役

早稲田大学卒業後、ソフトバンク株式会社にてAI活用やCEO直下案件のプロジェクトマネージャーに従事。その後、不動産スタートアップPit in株式会社の創業、他スタートアップでの業務改善・データ活用を経験後、2023年10月、株式会社ネクサフローを創業し代表取締役CEO就任。

次に読む

あわせて読みたい

Max Hodakが語るBCIの見方: 用途分類・感覚回復・長期研究の論点

Y Combinator の対談で語られたBCIの考え方を、用途分類、脳の学習、感覚回復の設計、長期研究の読み方という4つの観点で整理します。

2026/04/15

BCI神経科学AI

Sequoia「Services: The New Software」から読むAIサービス化の設計論

Sequoiaの「Services: The New Software」を、個別スタートアップの資金調達や市場規模の実況ではなく、AI企業がツールを売るのか、仕事の成果を売るのかを決めるための事業設計フレームとして読み直します。

SequoiaAI

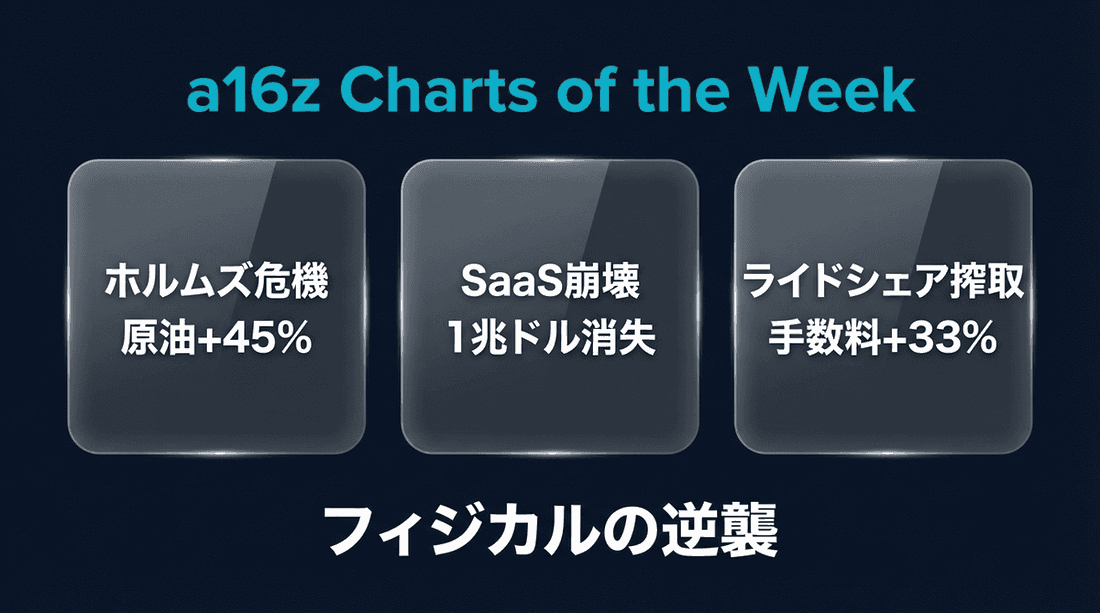

a16z週刊チャート解説:ホルムズ危機・SaaS崩壊・ライドシェア — 3つのチャートが映す2026年の構造転換

a16zの週刊チャートが示す3つの構造転換を徹底解説。ホルムズ海峡危機で原油45%急騰、SaaS株1兆ドル消失の「SaaSpocalypse」、ライドシェア手数料33%増の搾取構造。日本市場への影響と対策を独自分析。

AIマーケット