トレンドまとめ

AIコーディングツール5カテゴリ比較|Cursor・Devin・Lovable・Replit・LangChainの選び方

13分で読める|2026/04/15|

AI開発ツールエージェント比較コーディング

この記事の要約

Cursor、Devin、Lovable、Replit、LangChain は同じ土俵の競合ではありません。AI-native IDE、非同期エージェント、ブラウザ開発、prompt-first app builder、エージェント基盤という5つの surface に分けて、選び方を整理します。

Cursor、Devin、Lovable、Replit、LangChain を 1 枚のランキング表に並べても、現場の判断にはつながりません。重要なのは、どの会社が一番伸びているか ではなく、どの product surface を買うのか、誰が主役で、どこにコードと責任を置くのか です。

本記事では、AI コーディング関連の代表的な 5 つの選択肢を、企業価値や ARR の実況ではなく、IDE / 非同期実行 / ブラウザ開発 / prompt-first app builder / エージェント基盤 という役割で整理します。ツールの良し悪しではなく、どのチーム課題にどれが合いやすいかを見極めるための比較ガイドです。

本記事の前提

- 価格、プラン、利用上限、対応機能は変化が速いため、最終判断の前に必ず各社の current docs を確認してください

- 本記事は valuation や資金調達ニュースではなく、product surface と運用設計の違いに焦点を当てています

- 下線付きの用語にカーソルを合わせると解説が表示されます

この記事でわかること

- 5 社の違い: Cursor、Devin、Lovable、Replit、LangChain はどこが競合で、どこが補完関係なのか

- 選定軸: IDE 支援、非同期実行、プロトタイプ構築、ブラウザ開発、エージェント基盤のどれを選ぶべきか

- 導入時の論点: コードの正本、レビュー責任、課金単位、権限設計をどう見るべきか

基本情報

| 項目 | 内容 |

|---|---|

| トピック | AI コーディングツールの比較 |

| カテゴリ | トレンド / 技術解説 |

| 対象読者 | エンジニアリング責任者、プロダクトマネージャー、AI 導入を検討する CTO |

| 読み方 | 企業ランキングではなく、導入前のチェックリストとして読む |

まず結論: 5 社は同じ土俵にいない

最初に押さえたいのは、5 社がすべて「AI コーディングツール」という 1 つの箱に入るわけではないという点です。比較するなら、まず何を買っているのかを分ける必要があります。

| ツール | 何を買っているか | 主な利用者 | コードの正本 | 向いている場面 |

|---|---|---|---|---|

| Cursor | AI-native IDE + in-editor agent + Background Agents | 既存 repo で開発するエンジニア | 既存の Git repo / ローカルまたは接続先 repo | 人間が主役のまま、編集・レビュー・小規模自動化を速くしたい |

| Devin | 非同期で動く AI ソフトウェアエンジニア | Eng manager、platform team、開発組織 | 接続した Git repo + Devin の session / devbox | backlog や ticket を AI に委譲し、PR 単位で回したい |

| Lovable | prompt-first の Web app builder | PM、創業者、デザイナー、少人数開発 | Lovable project / GitHub sync / Supabase | まず動く Web アプリを作り、後から開発フローに接続したい |

| Replit | browser-native workspace + Agent + publishing | 個人開発、教育、browser-first なチーム | Replit workspace | セットアップなしで作り始め、共有やデプロイまで進めたい |

| LangChain stack | LangChain + LangGraph + LangSmith の構築レイヤー | アプリ開発者、platform engineer | 自社 repo / 自社 runtime | 自分たちで agent product や internal agent platform を作りたい |

この表だけでも、Cursor vs Devin と Lovable vs Replit は比較になりやすい一方で、LangChain は「買うツール」というより「自分で作るための部品」に近いことがわかります。

比較の前に答えるべき 5 つの質問

ツール名より先に、次の 5 問に答えると選定がぶれにくくなります。

1. 人間が主役か、AI が主役か

| 質問 | 見方 |

|---|---|

| 人間が IDE で書き続ける前提か | Cursor 寄り。AI は editor 内や PR review の支援役 |

| ticket ごと AI に任せたいか | Devin 寄り。session 単位で非同期に回して、PR で受け取る設計がしやすい |

| 自然言語から app を先に形にしたいか | Lovable / Replit 寄り。特に Web app 起点なら Lovable、browser workspace なら Replit |

| 自社固有の agent を組みたいか | LangChain / LangGraph / LangSmith 寄り |

2. コードの正本はどこに置くのか

- 既存 GitHub repo を中心に据えるなら Cursor や Devin が自然です

- Lovable は GitHub sync を前提にすると、GitHub を正本に寄せやすくなります

- Replit は workspace 起点の開発と相性が良く、まずはブラウザで完結させたい場面に向きます

- LangChain stack は自社 repo と runtime を自分で管理する前提です

3. フォアグラウンド作業か、バックグラウンド作業か

| 実行モデル | 向いている選択肢 |

|---|---|

| 会話しながらその場で編集したい | Cursor、Lovable、Replit |

| PR や issue を後ろで進めたい | Cursor Background Agents、Devin |

| 長めの agent workflow を作りたい | LangGraph / Deep Agents |

4. ガバナンスとレビューをどこで担保するか

この観点は demo では見えにくいですが、導入後の差が出やすいポイントです。

- 誰が secrets と権限を持つか

- 誰が PR / deploy / publish を承認するか

- usage budget を誰が監視するか

- prompt 履歴、rules、workspace 権限をどこまで残すか

- 監査、evaluation、incident response をどう回すか

5. 何に対して課金されるのか

月額だけで判断すると失敗しやすいです。見るべきは課金単位です。

| 観点 | 例 |

|---|---|

| editor seat / plan | Cursor の seat、Replit Core/Teams など |

| usage-based compute | Cursor Background Agents、Devin の ACU、Lovable / Replit の credit |

| runtime / hosting | Replit の publish、LangGraph / 自社 infra |

| observability / eval | LangSmith、追加の tracing / monitoring コスト |

Cursor: 既存 repo を速くする AI-native IDE

Cursor を選ぶときの本質は、「AI にコードを書かせるか」ではなく、既存のソフトウェア開発ループをどこまで editor 中心に保ったまま加速できるか にあります。

Cursor docs では、Agent がコードベースを探索し、複数ファイルを編集し、コマンドを実行し、エラー修正まで進める前提で整理されています。さらに project rules は .cursor/rules に置けて、GitHub integration と Background Agents を組み合わせると、issue や PR 起点の非同期実行にもつなげられます。

向いている場面

- 既存 repo と既存チームを前提に、生産性を上げたい

- 人間がレビュー責任を持ち続けたい

- editor 内の修正と、PR 単位の非同期処理を 1 つの体験に寄せたい

.cursor/rulesや AGENTS.md で repo ごとのルールを明示したい

先に確認したい論点

| 論点 | Cursor で見るべきこと |

|---|---|

| Background 実行 | GitHub app をどこまで許可するか。PR 作成まで自動化するのか |

| 課金単位 | editor seat と usage-based の agent 実行をどう分けて管理するか |

| レビュー体制 | Bugbot / PR review を補助として使うのか、必須 gate にするのか |

| ルール管理 | .cursor/rules、User Rules、AGENTS.md をどう使い分けるか |

| プライバシー設定 | org 単位でどの mode を選ぶか。どこまで codebase context を許可するか |

こういうチームに合いやすい

Cursor は、「エンジニアが自分の IDE を捨てたくない」「でも editor が AI の都合に合わせた別物になるのは避けたい」という組織に合いやすい選択肢です。完全自律よりも、人間がハンドルを持ったまま速くする ツールとして見ると位置づけが安定します。

Devin: ticket 単位で委譲しやすい非同期エージェント

Devin を検討するときは、IDE の拡張として見るより、チケット駆動で動く AI メンバー として捉えた方が実態に近いです。

Devin docs では、session ごとの作業、GitHub / Jira / Slack 連携、usage budget、Session Insights、enterprise deployment が整理されています。課金は ACU で管理され、Core は pay-as-you-go、Teams は seat と月次 ACU を組み合わせる設計です。つまり Devin は「どれだけ賢いか」だけでなく、どれだけ安全に backlog を流せるか が導入判断になります。

向いている場面

- backlog にある定型タスク、調査、移行、テスト整備を AI に任せたい

- issue / Jira ticket / PR ベースで作業を管理している

- エンジニアがずっと editor に張り付くより、非同期に並列実行したい

- usage budget と org-level 権限を管理できる

先に確認したい論点

| 論点 | Devin で見るべきこと |

|---|---|

| 委譲粒度 | 1 session に何を任せるか。大きすぎる task を投げない運用にできるか |

| 接続先権限 | GitHub、Jira、artifact repository、internal docs へのアクセスをどこまで開けるか |

| ACU 管理 | Team / Core ごとの usage budget と auto-reload をどう運用するか |

| レビュー動線 | Devin が出した PR を誰がどの SLA でレビューするか |

| sleep / wake 運用 | session を中断・再開しながら進める前提をチームが扱えるか |

こういうチームに合いやすい

Devin は、「AI に coding assist をしてほしい」より、「AI に仕事の束を渡して後で PR を受け取りたい」組織に向いています。人間との同期会話より、非同期キューのさばき方 が重要な現場ほど効きやすいツールです。

Lovable: prompt-first に Web アプリを形にする builder

Lovable は、IDE というより app builder として比較した方が誤解が少なくなります。

Lovable docs では、GitHub integration、Supabase integration、workspace roles、custom domains、Code mode、credit 制、Business plan の SSO / restricted projects / opt-out of data training などが整理されています。GitHub を接続した場合は two-way sync が可能で、GitHub を正本として扱う設計を取りやすくなります。

向いている場面

- PM や創業者が、まずは動く Web アプリを短時間で見たい

- Figma や static mock ではなく、実際に触れるプロトタイプが必要

- auth、DB、storage、Edge Functions まで含めて MVP を組みたい

- 後から GitHub に接続して、通常の開発フローへ移したい

先に確認したい論点

| 論点 | Lovable で見るべきこと |

|---|---|

| コードの正本 | Lovable project を主にするのか、GitHub sync 後に repo を正本にするのか |

| backend 境界 | Supabase をどこまで使うか。auth / RLS / storage / Edge Functions の責任分界をどうするか |

| workspace 権限 | roles / permissions、restricted projects、SSO が必要か |

| credit 管理 | メッセージ単位の消費をどの程度まで許容するか |

| 本番化のレビュー | Stripe、secrets、RLS、custom domain を誰が最終確認するか |

こういうチームに合いやすい

Lovable は、「まず app を出したいが、そのまま捨てる前提ではない」ケースに合いやすいです。単なる demo 生成ではなく、GitHub と backend をつなぎながら MVP を進める という位置づけで使うと強みが出ます。

Replit: browser-native workspace と Agent をまとめて使う

Replit の強みは、AI 単体というより workspace / editor / deploy / collaboration が 1 つの browser surface にまとまっている点です。

Replit docs では、browser-based workspace、Agent、Design Canvas、publishing、Secrets、team collaboration、mobile app、plan ごとの credit が案内されています。つまり Replit は「AI が強いから選ぶ」というより、ローカル環境なしで build, run, share を一気通貫にしたいか で判断すると使い分けやすくなります。

向いている場面

- ローカルセットアップなしで、すぐに試作したい

- 教育、ハッカソン、社内 workshop のように環境配布コストを減らしたい

- browser から app を作ってそのまま共有・公開したい

- モバイルからも project を触りたい

先に確認したい論点

| 論点 | Replit で見るべきこと |

|---|---|

| workspace 運用 | ブラウザ中心で十分か。ローカル IDE とどう共存させるか |

| credit と publish | Agent 利用、network transfer、storage、publish のコストをどう見るか |

| 権限と secrets | team collaboration、Secrets、公開範囲をどう制御するか |

| app の寿命 | 一時的な prototype か、継続運用する product か |

| 移行性 | GitHub 連携や export を使って、将来どこへ移すか |

こういうチームに合いやすい

Replit は、browser-first な開発体験そのものに価値がある場面で強いです。AI の品質だけでなく、環境構築をなくして試作と共有を回す ことが重要なら、有力な選択肢になります。

LangChain / LangGraph / LangSmith: 自分で agent を作るための層

LangChain をこの 4 社と同じ粒度で比べると混乱します。LangChain は end-user tool というより、自社で agent を構築するための framework / runtime / observability の組み合わせ だからです。

LangChain docs では、create_agent を中心とした高レベル API、LangGraph の durable execution と human-in-the-loop、Deep Agents の planning / subagent / file-system oriented workflow、LangSmith の tracing / monitoring / evaluation / alerts が分かれています。要するに、LangChain stack を選ぶのは「AI コーディングツールを買う」ときではなく、自分たちの agent product を作る ときです。

向いている場面

- 自社独自の agent workflow を product や internal tool に組み込みたい

- provider を固定せず、tooling や graph を自分で制御したい

- tracing、evaluation、prompt management を自前の開発プロセスに入れたい

- 長時間実行や HITL を含む orchestration を設計したい

先に確認したい論点

| 論点 | LangChain stack で見るべきこと |

|---|---|

| build vs buy | end-user tool を買うのではなく、自分で責任を持って作る覚悟があるか |

| runtime ownership | deploy、secrets、guardrails、cost control を誰が運用するか |

| graph 設計 | 単純な chat app なのか、durable workflow / HITL / memory が必要なのか |

| evaluation | LangSmith で何を測るか。offline eval / online monitor / alert をどう定義するか |

| 開発組織の成熟度 | repo、CI、eval、prompt versioning を回せるか |

こういうチームに合いやすい

LangChain stack は、「社内で使う AI coding assistant を 1 つ買えば済む」という話ではなく、AI を自社プロダクトの一部として実装する チームに向いています。導入効果は大きいですが、責任範囲も一緒に引き受ける必要があります。

競合しやすい組み合わせと、補完しやすい組み合わせ

Cursor vs Devin

この 2 つはどちらもエンジニアリング組織向けですが、競合軸は違います。

| 観点 | Cursor | Devin |

|---|---|---|

| 主役 | 人間のエンジニア | AI session |

| 作業単位 | editor 内の編集、会話、PR 補助 | ticket / task / session |

| 強い場面 | 既存 repo の高速化 | backlog の非同期委譲 |

| レビュー動線 | editor と PR の往復 | PR 受領と queue 管理 |

完全な二者択一ではなく、Cursor で日常開発を回しつつ、Devin に backlog を投げる という併用は現実的です。

Lovable vs Replit

この 2 つは「すぐ作り始める」用途で近く見えますが、主戦場は少し違います。

| 観点 | Lovable | Replit |

|---|---|---|

| 主軸 | prompt-first の Web app builder | browser-native workspace |

| 最初の価値 | 仕様を会話で app に落とす | セットアップ不要で build / run / share |

| backend 接続 | Supabase、GitHub、custom domain | publish、Secrets、workspace collaboration |

| 向くユーザー | PM、創業者、デザイナー、少人数チーム | 個人開発、教育、browser-first チーム |

LangChain は別レイヤー

LangChain stack は、Cursor / Devin / Lovable / Replit の代替というより、その先で自分たちの agent を作る側の選択肢です。買うツールの比較に混ぜると判断がぶれます。

用途別の選び方

| あなたの状況 | まず見るべき選択肢 | 理由 |

|---|---|---|

| 既存の product repo を持つエンジニア組織 | Cursor | IDE と GitHub review を崩さず、日常開発を速くしやすい |

| backlog / ticket を AI に並列で流したい | Devin | session / ticket / PR の非同期ループを作りやすい |

| PM や創業者が先に app を作り、後で repo に移したい | Lovable | prompt-first で MVP を組み、GitHub / Supabase に接続しやすい |

| セットアップ不要で試作、教育、ハッカソンを回したい | Replit | browser だけで build / run / share まで進めやすい |

| 自社独自の agent workflow や internal platform を作りたい | LangChain + LangGraph + LangSmith | framework / runtime / observability を自分で設計できる |

評価の観点: demo より先に見るべきもの

AI コーディングツールは demo ではどれも良く見えます。実運用で差が出るのは、次の論点です。

1. source of truth が明確か

- GitHub を正本にするのか

- workspace を正本にするのか

- prompt から生成したコードを誰が merge するのか

2. 権限と secrets の境界が明確か

- production secret をどこまで AI から触らせるか

- deploy 権限を誰が持つか

- third-party integration をどう承認するか

3. background 実行のコストが読めるか

- ACU、credits、usage-based compute がどこで膨らむか

- 長時間の session を誰が止めるか

- org-level の上限設定があるか

4. 失敗時のレビュー体制があるか

- 生成コードを誰がレビューするか

- PR に何を必須チェックとして置くか

- 本番 deploy 前に security / data / billing を誰が見るか

5. 監視と評価の仕組みがあるか

- IDE 補助だけで終わるのか

- 生成された app や agent を継続運用するのか

- trace、eval、alert を残す必要があるのか

よくある質問(FAQ)

Q1. Cursor と Devin はどちらから始めるべきですか?

既存 repo で開発しているエンジニアが主役なら Cursor から始める方が安全です。AI に ticket 単位で仕事を渡して PR で受け取りたいなら Devin の価値が出やすくなります。違いは「どちらが賢いか」より、「誰が運転席に座るか」です。

Q2. Lovable と Replit の違いは何ですか?

Lovable は prompt-first に Web app を形にし、GitHub や Supabase に接続しながら MVP を進めるのが得意です。Replit は browser-based workspace と publishing をまとめて使えるのが強みです。会話から app を組みたいか、browser workspace で build / run / share したいか で見分けると整理しやすくなります。

Q3. LangChain は AI コーディングツールとして使うものですか?

直接の代替ではありません。LangChain / LangGraph / LangSmith は、自分たちで agent を作るための framework / runtime / observability です。既製の coding tool を選ぶ話と、自社プロダクトに agent を組み込む話は分けて考える方が安全です。

Q4. 価格はどう比較すべきですか?

月額の headline price ではなく、seat / credit / ACU / background compute / hosting / observability のどれが増えるかで見てください。AI コーディング系は usage-based 部分が支配的になりやすく、ここを見落とすと導入後に想定が崩れます。

Q5. 何を 2 週間で検証すれば十分ですか?

2 週間の試験導入なら、次の 4 点を確認できれば十分です。

- 既存 repo や workflow に無理なく入るか

- 誰が review / deploy の責任を持つか明確か

- usage budget の見通しが立つか

- 失敗した output を修正する運用が回るか

まとめ

主要ポイント

- 5 社は同じカテゴリではない: Cursor は AI-native IDE、Devin は非同期エージェント、Lovable は prompt-first app builder、Replit は browser-native workspace、LangChain stack は構築レイヤーです。

- 導入判断で重要なのは metrics ではなく責任分界: 誰が主役か、どこにコードを置くか、どこでレビューするか、何に対して課金されるかを先に決めるべきです。

- buy と build を混ぜない: end-user tool を買う話と、自社 agent platform を作る話は別の意思決定です。

次のステップ

- まず自社の bottleneck が

editor 内の生産性なのか、backlog の非同期処理なのか、試作の速さなのかを切り分ける - その bottleneck に合わせて 1 つだけ試験導入し、review / budget / secret 管理の運用を先に決める

- 複数ツールを併用する場合も、source of truth と deploy 権限だけは最初に固定する

参考リソース

Cursor

Devin

Lovable

Replit

LangChain

本記事はネクサフローの AI 研究シリーズの一部です。

この記事の著者

中村 知良

代表取締役

早稲田大学卒業後、ソフトバンク株式会社にてAI活用やCEO直下案件のプロジェクトマネージャーに従事。その後、不動産スタートアップPit in株式会社の創業、他スタートアップでの業務改善・データ活用を経験後、2023年10月、株式会社ネクサフローを創業し代表取締役CEO就任。

次に読む

あわせて読みたい

Max Hodakが語るBCIの見方: 用途分類・感覚回復・長期研究の論点

Y Combinator の対談で語られたBCIの考え方を、用途分類、脳の学習、感覚回復の設計、長期研究の読み方という4つの観点で整理します。

2026/04/15

BCI神経科学AI

Sequoia「Services: The New Software」から読むAIサービス化の設計論

Sequoiaの「Services: The New Software」を、個別スタートアップの資金調達や市場規模の実況ではなく、AI企業がツールを売るのか、仕事の成果を売るのかを決めるための事業設計フレームとして読み直します。

SequoiaAI

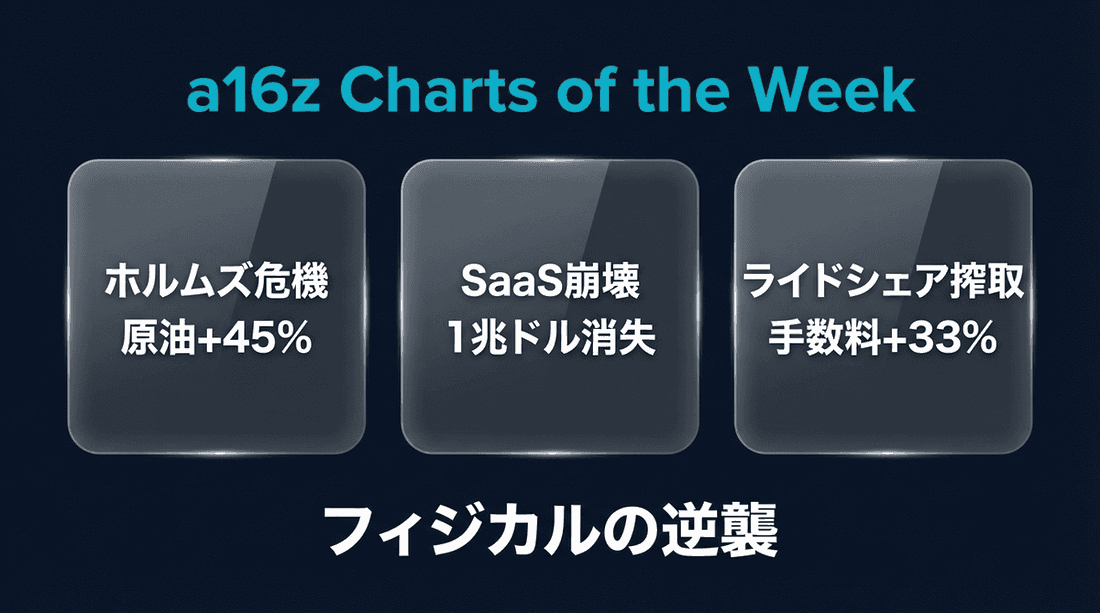

a16z週刊チャート解説:ホルムズ危機・SaaS崩壊・ライドシェア — 3つのチャートが映す2026年の構造転換

a16zの週刊チャートが示す3つの構造転換を徹底解説。ホルムズ海峡危機で原油45%急騰、SaaS株1兆ドル消失の「SaaSpocalypse」、ライドシェア手数料33%増の搾取構造。日本市場への影響と対策を独自分析。

AIマーケット