トレンドまとめ

AIエージェントセキュリティ入門:Promptfooが示す評価とレッドチームの重要性

9分で読める|2026/04/15|

AIセキュリティAIエージェント

この記事の要約

Promptfooは、LLM evals と red teaming を担うツール群の代表例です。本記事では買収や市場予測ではなく、AIエージェントの security lifecycle を identity、権限制御、eval/red team、監視の4層で整理します。

Promptfoo が OpenAI に加わるという出来事は、AI エージェントのセキュリティが「導入後に監査部門が見るもの」ではなく、開発と運用の途中に組み込むべき機能になってきたことを示しています。重要なのは買収額や市場規模の予測ではなく、eval / red team の仕組みを agent workflow のどこに置くかです。

本記事では、promptfoo を LLM evals & red teaming の代表例として扱いながら、AI エージェントを安全に運用するための設計原則を整理します。変わりやすい M&A や資金調達の snapshot ではなく、identity / permission / evaluation / monitoring の4層に絞って見ます。

本記事のスコープ

- Promptfoo を eval / red team カテゴリの代表例として扱います

- 買収額、市場規模予測、導入社数のような変化しやすい snapshot は扱いません

- 実務では Promptfoo に限らず、同等の評価基盤や社内基盤にも置き換えられる考え方を整理します

この記事でわかること

- Promptfoo が担う役割: agent platform そのものではなく、eval / red team / CI gate を担う理由

- AI エージェント特有のセキュリティ論点: identity、権限、ツール接続、非決定性がなぜ難しいのか

- 運用の4層モデル: inventory、権限制御、eval / red team、監視の順で何を整えるべきか

- ベンダー選定の見方: M&A ニュースではなく、license / evidence / integration をどう確認するか

基本情報

| 項目 | 内容 |

|---|---|

| トピック | AIエージェントセキュリティ |

| カテゴリ | 技術解説・運用設計 |

| 難易度 | 中級 |

| 対象読者 | CTO/CISO、AI導入担当者、platform / security 担当者 |

AIエージェントセキュリティの全体像

AIエージェントセキュリティの全体像Promptfooは何を担うツールか

promptfoo の README では、LLM evals & red teaming を主目的にした CLI / library として整理されています。つまり promptfoo が担う中心は、エージェントの「実行基盤」ではなく、出力品質と安全性をどのように測るかです。

AI エージェントの実務では、次の3つが混ざりやすくなります。

| レイヤー | 主な役割 | 代表的な成果物 |

|---|---|---|

| orchestration / runtime | tool 呼び出し、workflow 実行、memory 管理 | 実行ログ、状態遷移、ジョブ結果 |

| eval / red team | 回答品質、脆弱性、回帰を確認 | テスト結果、失敗ケース、比較レポート |

| governance / review gate | 本番投入の可否判断、証跡の確認 | CI 判定、レビュー記録、承認履歴 |

この切り分けを曖昧にすると、「エージェントが動いたか」と「安全に動いてよいか」が同じ話に見えてしまいます。Promptfoo のような評価基盤が重要なのは、agent を速く動かすためではなく、安全に止めるための基準を持てるからです。

README と company update で確認したい論点も、導入社数や調達額ではありません。実務で重要なのは次の点です。

- open source / MIT license が継続するか

- CI/CD に組み込めるか

- model 比較と vulnerability scanning を同じフローで扱えるか

- security review に渡せる証跡を出力できるか

なぜAIエージェントのセキュリティは難しいのか

AI エージェントのセキュリティが難しいのは、単に LLM が入ったからではありません。権限を持った自動化と非決定的な出力が結びつくからです。

| 論点 | 典型的な失敗例 | 必要な対策 |

|---|---|---|

| identity | 人間のアカウントや共有 API key を agent が流用する | agent ごとの識別子、owner、承認境界 |

| permission | tool に広すぎる権限を渡し、不要な更新や参照が可能になる | 最小権限、task ごとの権限分離 |

| model behavior | prompt injection、jailbreak、data leakage が起きる | eval / red team、回帰テスト |

| workflow chaining | 1つの unsafe action が他システムや別 agent へ連鎖する | 実行ログ、停止条件、ロールバック設計 |

従来のアプリケーションセキュリティでも input validation や audit log は重要でした。ただ、AI エージェントでは「何をするか」が実行時に変化しやすいため、静的な allowlist だけでは足りません。設計時の権限制御と運用時の評価・監視を両方持つ必要があります。

AIエージェントセキュリティの4層モデル

1. Inventory と identity

最初に必要なのは、「何体の agent が、どの業務で、誰の責任で動いているか」を明確にすることです。

- agent ごとに owner と利用目的を持たせる

- human アカウントと agent 用 identity を分ける

- PoC と本番で credential を共有しない

- どの tool / data source に触れるかを棚卸しする

ここが曖昧だと、後から eval を足しても事故の責任境界が見えません。

2. 権限制御と tool boundary

AI エージェントは「読める」だけでなく「実行できる」ことが多いため、権限の切り方が重要です。

- task 単位で必要最小限の token / credential を渡す

- write 系 tool と read 系 tool を分離する

- 承認が必要な action を明示し、自動実行から外す

- RAG や memory に入る機密データの範囲を先に決める

安全な agent は、万能な agent ではありません。できることを増やす前に、やってはいけないことを狭く定義する方が実務では効きます。

3. Eval / red team

ここで Promptfoo のような基盤が効きます。目的は「脆弱性がゼロであること」を証明することではなく、どの failure mode をどの頻度で再現し、CI で止めるかを定義することです。

AIエージェントセキュリティ対策の4層

AIエージェントセキュリティ対策の4層最低限、次の観点を継続評価の対象にします。

- prompt injection や jailbreak の試行にどう応答するか

- data leakage や tool misuse を誘発する入力に耐えられるか

- model / prompt / system policy 変更後に回帰していないか

- 多言語入力や長文コンテキストで挙動が崩れないか

eval / red team はセキュリティ部門だけの仕事ではありません。prompt や tool schema を変える開発チームが、PR や release gate の一部として扱う必要があります。

4. 監視・ログ・インシデント対応

本番に入った後は、テストに通ったことより「異常が起きたときに止められること」が重要です。

- agent の行動ログと tool 呼び出しを追跡できるようにする

- 異常な権限昇格、連続実行、想定外の外部送信を監視する

- 失敗した eval case をインシデント後の再発防止テストへ戻す

- kill switch と human takeover の手順を決めておく

AI エージェントの監視は、単なる observability ではありません。事故後に再現できるかまで含めて初めて security control になります。

Promptfooのような評価基盤を入れる前に決めること

ツール導入を急ぐ前に、次の論点を決めておくと運用がぶれにくくなります。

| 論点 | 先に決めること |

|---|---|

| 評価軸 | 何を良い出力とみなし、何を failure とみなすか |

| failure の owner | eval failure を誰が直し、どこまで security review に戻すか |

| provider 差分 | model をまたいで同じ prompt を比較してよいか |

| security scope | red team の対象を prompt だけにするか、tool / RAG まで広げるか |

| evidence 共有 | CI、PR、監査でどの形式の結果を残すか |

ここが決まっていない状態で eval ツールを入れると、「スコアは出るが、誰も意思決定に使わない」状態になりがちです。

M&Aニュースを見るときの確認ポイント

Promptfoo のようなツールが大手 platform に加わるとき、追うべきなのは市場予測より継続性と境界です。

- OSS と managed feature の境界がどう変わるか

- license と project governance が維持されるか

- CI/CD integration や export など、現場で使う接点が残るか

- security review に必要な証跡を外部へ持ち出せるか

- vendor lock-in なしで eval case を再利用できるか

この見方を持っておくと、買収や提携のニュースを「盛り上がっている市場」の話ではなく、自社の security lifecycle に何が組み込みやすくなるかとして読めます。

日本企業が先に整えるべき順番

日本企業では、AI 活用の議論が先に進み、security review が後から追いつく構図になりがちです。順番としては次の形が安全です。

- agent inventory を作る: どの部署が、どの agent を、何の権限で使うかを一覧化する

- 本番権限を分ける: PoC と production で credential、approval flow、log retention を分ける

- 公開フレームワークを共通語彙にする: OWASP LLM Top 10 や MITRE ATLAS のような公開フレームワークを、社内レビューの会話の土台にする

- eval を release gate に入れる: prompt 更新や model 切り替えを human review だけに頼らない

要するに、AI エージェントの security は「導入可否」の議論ではなく、どの control をどのタイミングで差し込むかの設計です。

よくある質問(FAQ)

Q1. PromptfooはOpenAI参加後も使えますか?

README と company update では、open source / MIT license の継続が案内されています。ただし、商用機能や managed feature の位置づけは変わりうるため、導入前には current docs と terms を確認してください。

Q2. AIエージェントセキュリティと従来のアプリケーションセキュリティの最大の違いは何ですか?

最大の違いは、非決定的な出力を持つ自動化が権限付きで動くことです。入力検証やアクセス制御だけでなく、eval / red team と行動ログが release と運用の両方で必要になります。

Q3. 中小企業でもここまで必要ですか?

はい。ただし最初から大規模基盤を入れる必要はありません。agent inventory、権限分離、少数の red team case、ログ保存の4点から始めれば十分です。

Q4. 最初に導入すべきなのは評価ツールですか?

評価ツールは重要ですが、それだけでは不十分です。先に owner、identity、tool boundary を決めないと、eval failure が出ても誰がどこを直すか分かりません。

Q5. Promptfoo以外の基盤でも同じ考え方で進められますか?

進められます。本質は製品名ではなく、eval case を定義し、CI で回し、失敗を運用改善へ戻せるかです。社内基盤や他製品でも、この lifecycle があれば考え方は同じです。

まとめ

Promptfoo のニュースが示しているのは、AI エージェントセキュリティが「市場として伸びる」という話より、eval / red team が agent platform の近くへ移動しているという変化です。実務で見るべきなのは acquisition headline ではなく、identity、権限、evaluation、monitoring の4層をどこまで回せるかです。

AI エージェントを安全に運用したいなら、まずは inventory と権限分離を整え、その上で Promptfoo のような評価基盤を CI と review gate に組み込みます。セキュリティを後付けで足すのではなく、止め方まで含めて設計することが出発点です。

関連記事

参考リソース

本記事はネクサフローのAI研究シリーズの一部です。

この記事の著者

中村 知良

代表取締役

早稲田大学卒業後、ソフトバンク株式会社にてAI活用やCEO直下案件のプロジェクトマネージャーに従事。その後、不動産スタートアップPit in株式会社の創業、他スタートアップでの業務改善・データ活用を経験後、2023年10月、株式会社ネクサフローを創業し代表取締役CEO就任。

次に読む

あわせて読みたい

Max Hodakが語るBCIの見方: 用途分類・感覚回復・長期研究の論点

Y Combinator の対談で語られたBCIの考え方を、用途分類、脳の学習、感覚回復の設計、長期研究の読み方という4つの観点で整理します。

2026/04/15

BCI神経科学AI

Sequoia「Services: The New Software」から読むAIサービス化の設計論

Sequoiaの「Services: The New Software」を、個別スタートアップの資金調達や市場規模の実況ではなく、AI企業がツールを売るのか、仕事の成果を売るのかを決めるための事業設計フレームとして読み直します。

SequoiaAI

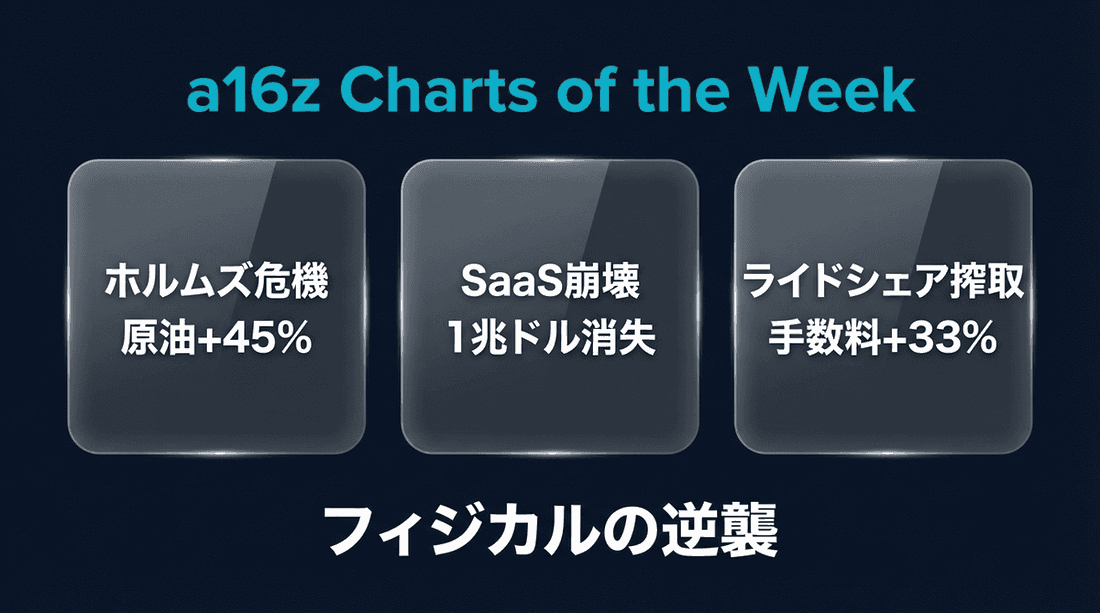

a16z週刊チャート解説:ホルムズ危機・SaaS崩壊・ライドシェア — 3つのチャートが映す2026年の構造転換

a16zの週刊チャートが示す3つの構造転換を徹底解説。ホルムズ海峡危機で原油45%急騰、SaaS株1兆ドル消失の「SaaSpocalypse」、ライドシェア手数料33%増の搾取構造。日本市場への影響と対策を独自分析。

AIマーケット