トレンドまとめ

AIエージェント開発に役立つ一次文献11選|基礎論文から最新仕様まで

12分で読める|2026/04/15|

AI新技術革新データ分析

この記事の要約

AIエージェント開発を理解するために参照したい一次文献11本を厳選。Transformer、CoT、ReAct などの基礎論文に加え、Computer Use、Swarm、MCP、A2A といった公式実装・仕様も含めて、設計・評価・運用の観点から読み方を整理します。

AIエージェント開発を深く理解したいなら、二次解説より先に一次文献へ戻るのが近道です。本記事では、古典的な基礎論文に加えて、いま実装判断に直結しやすい公式仕様・公式ドキュメントも含めた11本を整理します。

本記事でいう「一次文献」

- 査読論文や arXiv 論文

- 公式仕様書

- 公式 README / 公式実装ドキュメント

AIエージェント分野では、論文だけでなく仕様や公式 docs 自体が実装上の正本になるため、この記事ではそれらも同列に扱います。

この記事でわかること

- 最初に読むべき基礎論文: Transformer、Chain-of-Thought、ReAct のどこが今も設計の土台なのか

- 実装に直結する一次文献: Computer Use、SWE-Agent、Swarm、MetaGPT をどう読み分けるか

- 評価と相互運用の見方: AgentBench、MCP、A2A を通じて運用設計まで視野に入れる方法

基本情報

| 項目 | 内容 |

|---|---|

| トピック | AIエージェントの一次文献ガイド |

| カテゴリ | 技術解説 |

| 文献数 | 11本(基礎3本・実装4本・評価/標準4本) |

| 想定読者 | エージェントを設計・実装・評価したい人 |

なぜ一次文献を読むべきか

AIエージェント領域は変化が速く、解説記事だけを追うと「その時点の言い切り」に引っ張られがちです。一次文献を押さえる価値は、主に次の3つです。

1. 何が事実で、何が解釈かを分けられる

論文は著者の主張、仕様書は設計者の前提、公式 docs は現行の制約を示します。どこまでが確認済みで、どこからが解説者の解釈かを切り分けやすくなります。

2. 実装上の境界条件が見える

ベータ機能の前提、セキュリティ上の注意、評価ベンチマークの限界などは、一次文献に最も明確に書かれています。導入判断で外せない情報です。

3. 流行語ではなく設計原理を押さえられる

「マルチエージェント」「メモリ」「標準化」といった言葉は広く使われますが、中身は文献ごとに異なります。原典に当たると、どの抽象が本当に有効かを見極めやすくなります。

本記事の選定基準

11本は、単に有名だからではなく、エージェント設計で再利用しやすい観点から選んでいます。

AIエージェント推薦文献の概念図

AIエージェント推薦文献の概念図| 基準 | 説明 |

|---|---|

| 原理性 | 現在のエージェント設計でも参照価値がある抽象を示している |

| 実装接続性 | 実際の agent loop、tool use、評価設計に落とし込みやすい |

| 継続性 | 年次の話題性より、数か月後も参照しやすい内容である |

| 追跡可能性 | 著者・仕様策定者・公式実装のいずれかへ一次リンクで遡れる |

AIエージェント文献カテゴリマップ

AIエージェント文献カテゴリマップ【基礎編】最初に押さえるべき3本

1. Attention Is All You Need (2017)

| 項目 | 内容 |

|---|---|

| 種別 | 研究論文 |

| 著者 | Vaswani et al. |

| 発表 | NeurIPS 2017 |

3行で要約

- 系列変換を、再帰や畳み込みではなく Attention 中心で構成できると示した論文です。

- self-attention によって並列計算しやすい構造を実現しました。

- いまの LLM 実務で頻出する「長い文脈」「計算コスト」「位置表現」の起点がここにあります。

なぜ読むべきか

AIエージェントは LLM の上に構築されるため、モデルの得意不得意を理解しないまま loop 設計だけを議論しても限界があります。Transformer の前提を知っておくと、長コンテキスト設計や retrieval の必要性を説明しやすくなります。

2. Chain-of-Thought Prompting Elicits Reasoning in Large Language Models (2022)

| 項目 | 内容 |

|---|---|

| 種別 | 研究論文 |

| 著者 | Wei et al. |

| 発表 | NeurIPS 2022 |

3行で要約

- 中間推論ステップを明示させる prompting が、十分大きいモデルでは複数の推論課題を改善することを示しました。

- 単発回答よりも「途中の思考をどう外化するか」が性能に効く場面を明らかにしました。

- 以後の decomposition、reflection、verifier 系設計の土台になった論文です。

なぜ読むべきか

この論文は、なぜ task decomposition や中間生成が agent 設計で繰り返し出てくるのかを理解する助けになります。現行製品が内部で何をしているかを断定するためではなく、段階的推論を外部設計へ落とす発想を学ぶために読む価値があります。

3. ReAct: Synergizing Reasoning and Acting in Language Models (2022)

| 項目 | 内容 |

|---|---|

| 種別 | 研究論文 |

| 著者 | Yao et al. |

| 発表 | ICLR 2023 |

3行で要約

- 推論と行動を交互に進める

Thought -> Action -> Observationの基本ループを提示しました。 - reasoning trace が行動計画を助け、行動結果が次の推論を更新する構造です。

- いまの多くの tool-using agent が採るループの原型として読みやすい論文です。

なぜ読むべきか

ReAct は「どのツールを呼ぶか」より前に、「観測結果をどう次の判断へ戻すか」を考えさせてくれます。エージェントの stop 条件、ログ設計、tool result の整形など、運用上の論点を整理する出発点になります。

【実装編】設計感覚を鍛える4本

4. Anthropic Computer Use ドキュメント

| 項目 | 内容 |

|---|---|

| 種別 | 公式ドキュメント |

| 提供元 | Anthropic |

| 主題 | GUI 操作、sandbox、agent loop、安全対策 |

3行で要約

- Computer Use は、スクリーンショットを見てマウス・キーボード操作を行うベータ機能です。

- 公式 docs は、beta header、agent loop、sandboxed environment、tool version を明示しています。

- GUI automation を扱うなら、一般論より制約条件の理解が先に必要だと教えてくれます。

なぜ読むべきか

GUI 系エージェントは、理論よりも実装条件の差分で壊れやすい領域です。Anthropic の docs は、安全確認、Docker ベースの reference implementation、スクリーンショット処理、データ保持の前提まで含めて確認できるので、噂ベースの比較より優先して読むべき文書です。

5. SWE-Agent: Agent-Computer Interfaces Enable Automated Software Engineering (2024)

| 項目 | 内容 |

|---|---|

| 種別 | 研究論文 |

| 著者 | Yang, Jimenez, Wettig, Lieret, Yao et al. |

| 発表 | 2024 |

3行で要約

- ソフトウェア修正タスク向けに、エージェント専用の Agent-Computer Interface を設計した研究です。

- コード検索、編集、テスト実行を一連の操作として扱いやすくしました。

- 「モデル性能」だけでなく「インターフェース設計」が agent の成否を左右することを示しています。

なぜ読むべきか

coding agent を作るときに重要なのは、賢いモデル名よりも、探索・編集・検証の流れをどう道具立てするかです。SWE-Agent は、CLI や IDE を人間向けのまま使わせる限界と、専用インターフェースの利点を具体的に理解させてくれます。

- 原典: SWE-Agent: Agent-Computer Interfaces Enable Automated Software Engineering

- 関連 benchmark: SWE-bench: Can Language Models Resolve Real-World GitHub Issues?

6. Swarm README / OpenAI Agents SDK への移行案内

| 項目 | 内容 |

|---|---|

| 種別 | 公式実装 README |

| 提供元 | OpenAI |

| 公開 | 2024 |

3行で要約

- Swarm は

Agentとhandoffを最小単位にした軽量な multi-agent orchestration の実験実装です。 - 現在の README では、Swarm は experimental / educational で、production には Agents SDK への移行が推奨されています。

- 最小構成で handoff の設計を学ぶ教材としては今も有用です。

なぜ読むべきか

Swarm を読む価値は、「そのまま採用すること」より「どこまでを軽量抽象で表現できるか」を掴むことにあります。multi-agent を必要以上に複雑化しないための視点を得られます。

- 原典: openai/swarm

- 参照先: OpenAI Agents SDK

7. MetaGPT: Meta Programming for A Multi-Agent Collaborative Framework (2023)

| 項目 | 内容 |

|---|---|

| 種別 | 研究論文 |

| 著者 | Hong et al. |

| 発表 | 2023 |

3行で要約

- プロダクトマネージャー、アーキテクト、エンジニアのような役割をエージェントに割り当て、SOP で協調させる枠組みです。

- 自由会話よりも、構造化された中間成果物を中心に連携する設計を重視します。

- multi-agent を「役割分担」ではなく「成果物の受け渡し」として考える助けになります。

なぜ読むべきか

複数エージェントを導入しても、中間成果物の形式が曖昧だと品質は安定しません。MetaGPT は、役割名を増やすより、どの artifact を誰が作り、誰が消費するかを定義する重要性を示します。

【評価・標準編】実運用に近づく4本

8. Voyager: An Open-Ended Embodied Agent with Large Language Models (2023)

| 項目 | 内容 |

|---|---|

| 種別 | 研究論文 |

| 著者 | Wang et al. |

| 発表 | 2023 |

3行で要約

- Minecraft 環境で、エージェントが自動カリキュラムとスキルライブラリを使って継続的に能力を拡張する研究です。

- 一度得た手続きをコードとして保存し、後続タスクに再利用します。

- 長期タスクで agent がどう成長するかを考えるうえで代表的な文献です。

なぜ読むべきか

「学習するエージェント」を語るとき、単に会話履歴を保存するだけでは足りません。Voyager は、経験をスキル化して再利用する発想を具体的に示しており、長期運用の設計ヒントになります。

9. A-MEM: Agentic Memory for LLM Agents (2025)

| 項目 | 内容 |

|---|---|

| 種別 | 研究論文 |

| 著者 | Xu et al. |

| 発表 | 2025 |

3行で要約

- 過去のやり取りを単に埋め込み検索へ流すのではなく、構造化されたメモとして整理する memory 研究です。

- Zettelkasten 的なノート構造と agent 主導の記憶管理を組み合わせます。

- 「何を覚えるか」「どう取り出すか」を分けて考えるきっかけになります。

なぜ読むべきか

メモリ機構は便利そうに見えて、書き込み過多や古い記憶の混入で壊れやすい領域です。A-MEM を読むと、メモリは保存量ではなく整理・検索・更新方針の問題だとわかります。

10. AgentBench: Evaluating LLMs as Agents (2023)

| 項目 | 内容 |

|---|---|

| 種別 | 研究論文 |

| 著者 | Liu et al. |

| 発表 | ICLR 2024 |

3行で要約

- LLM を agent として評価するために、複数環境をまたぐ multi-turn benchmark を定義した研究です。

- コード、データベース、知識グラフ、ゲーム、Web など、単発 QA より実運用に近い設定を扱います。

- エージェント評価は出力品質だけでなく、連続的な意思決定を見るべきだと示しています。

なぜ読むべきか

本番の agent で事故が起きるのは、1回答の質よりも、長い手順の途中で判断を誤るときです。AgentBench は、評価設計を single-turn prompt test から scenario test へ広げる必要性を理解させてくれます。

11. MCP / A2A 仕様

| 項目 | 内容 |

|---|---|

| 種別 | 公式仕様 |

| 提供元 | MCP community / A2A project |

| 主題 | tool 接続、context 共有、agent 間協調 |

3行で要約

- MCP は、host / client / server 間で context、tools、prompts をやり取りするための標準仕様です。

- A2A は、異なるフレームワークやベンダー上の agent 同士が能力を公開し、長い task を協調実行するための open protocol です。

- どちらも「自前の接着コード」を減らし、相互運用の語彙を揃える役割を持ちます。

なぜ読むべきか

エージェント実装が進むほど、問題はモデル性能より接続境界に移ります。MCP は tool 接続の境界、A2A は agent 間協調の境界を整理するのに有効です。特にベンダー横断で構成するなら、ブログ比較より仕様の語彙を直接読むほうが早いです。

文献を効率的に読む順番

全部を順番に読む必要はありません。目的ごとに読み順を変えた方が早いです。

最短ルート

- 基礎を1本: ReAct か Attention Is All You Need

- 実装を1本: Computer Use docs か SWE-Agent

- 運用を1本: AgentBench か MCP / A2A

目的別おすすめ読み順

| 目的 | 推奨読み順 |

|---|---|

| まず agent loop を作りたい | ReAct → Computer Use docs → SWE-Agent |

| coding agent を設計したい | ReAct → SWE-Agent → AgentBench |

| multi-agent を整理したい | Swarm → MetaGPT → A2A |

| tool 接続を標準化したい | ReAct → MCP → A2A |

| 長期運用と memory を考えたい | Voyager → A-MEM → AgentBench |

AIエージェント文献の読み順フロー

AIエージェント文献の読み順フローネクサフローで重視している読み方

実務では、次の3点に絞って読むと再利用しやすくなります。

1. どの抽象が本質か

ReAct なら observation loop、SWE-Agent なら ACI、MCP なら host / client / server です。固有名詞ではなく、再利用できる抽象を抜き出します。

2. 制約がどこにあるか

Computer Use なら beta header や sandbox、AgentBench なら評価環境の前提です。失敗条件がどこにあるかを先に確認します。

3. 中間成果物をどう定義しているか

MetaGPT や A-MEM は、最終回答よりも中間 artifact の設計が重要です。multi-agent や memory を使うときほど、この観点が効きます。

まとめ

AIエージェントを理解するうえで、読むべき一次文献は「論文だけ」ではありません。基礎論文で原理を押さえ、公式 docs や仕様で現在の実装条件を確認し、benchmark で評価の目線を持つ。この3層を揃えると、流行語ではなく設計判断としてエージェントを扱えるようになります。

AIエージェント選択の階層図

AIエージェント選択の階層図主要ポイント

- 基礎3本で原理を押さえる: Attention、CoT、ReAct はいまも設計の共通語彙です。

- 実装4本で loop を具体化する: Computer Use、SWE-Agent、Swarm、MetaGPT は agent の形を現実に落とします。

- 評価/標準4本で運用を考える: Voyager、A-MEM、AgentBench、MCP / A2A が長期運用と相互運用の視点を補います。

次のステップ

- まずは ReAct を読み、観測結果を次の行動へ戻す loop を理解する

- 続いて SWE-Agent か Computer Use docs を読み、実装条件を把握する

- 最後に AgentBench と MCP / A2A を読んで、評価と接続境界を設計に入れる

よくある質問(FAQ)

Q1. 英語が苦手でも読めますか?

読めます。Abstract、Conclusion、図、表だけでも十分に価値があります。仕様書は論文より短く、制約条件が箇条書きで書かれていることも多いです。

Q2. 最初から11本すべて読むべきですか?

必要ありません。まずは基礎1本、実装1本、評価/標準1本の計3本で十分です。必要に応じて周辺文献へ広げてください。

Q3. まず何から読むべきですか?

LLM の癖を理解したいなら Attention Is All You Need、agent loop を理解したいなら ReAct、すぐ実装したいなら SWE-Agent か Computer Use docs がおすすめです。

Q4. 一次文献を実装に落とすコツはありますか?

論文の結論をそのまま再現しようとせず、loop、memory、handoff、evaluation のどの論点に効く文献なのかを先に決めると読みやすくなります。

Q5. 最新動向はどこで追えばよいですか?

論文は arXiv、仕様は各プロジェクトの specification / GitHub、実装の変化は公式 docs と release notes を追うのが最短です。特にベータ機能や標準仕様は、数か月で前提が変わることがあります。

参考リソース

- arXiv - 論文の原典に最短でたどれる

- Papers With Code - 論文と実装を行き来しやすい

- Model Context Protocol - MCP の仕様とガイド

- A2A Protocol - A2A の仕様と実装ガイド

本記事は 2026-04-15 時点の一次情報で全文見直し済みです。

この記事の著者

中村 知良

代表取締役

早稲田大学卒業後、ソフトバンク株式会社にてAI活用やCEO直下案件のプロジェクトマネージャーに従事。その後、不動産スタートアップPit in株式会社の創業、他スタートアップでの業務改善・データ活用を経験後、2023年10月、株式会社ネクサフローを創業し代表取締役CEO就任。

次に読む

あわせて読みたい

Max Hodakが語るBCIの見方: 用途分類・感覚回復・長期研究の論点

Y Combinator の対談で語られたBCIの考え方を、用途分類、脳の学習、感覚回復の設計、長期研究の読み方という4つの観点で整理します。

2026/04/15

BCI神経科学AI

Sequoia「Services: The New Software」から読むAIサービス化の設計論

Sequoiaの「Services: The New Software」を、個別スタートアップの資金調達や市場規模の実況ではなく、AI企業がツールを売るのか、仕事の成果を売るのかを決めるための事業設計フレームとして読み直します。

SequoiaAI

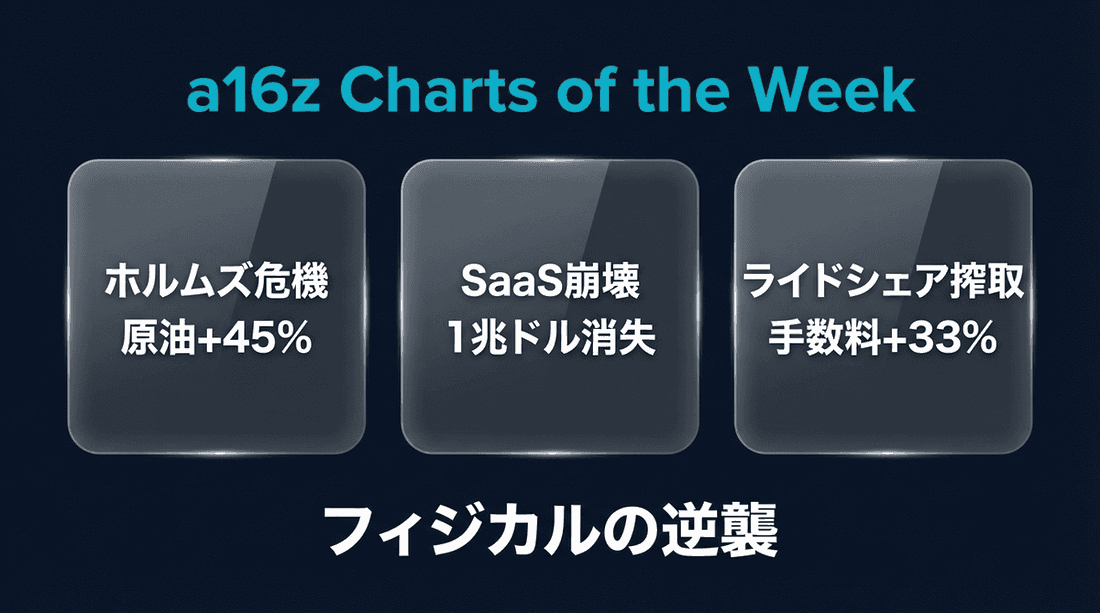

a16z週刊チャート解説:ホルムズ危機・SaaS崩壊・ライドシェア — 3つのチャートが映す2026年の構造転換

a16zの週刊チャートが示す3つの構造転換を徹底解説。ホルムズ海峡危機で原油45%急騰、SaaS株1兆ドル消失の「SaaSpocalypse」、ライドシェア手数料33%増の搾取構造。日本市場への影響と対策を独自分析。

AIマーケット