スタートアップ分析

GTM Alphaとは?同じツールを使っても勝てない理由とデータ戦略の作り方

27分で読める|2026/03/29|

GTM AlphaGTM戦略データ戦略GTMエンジニアリングセールステック

月曜の朝8時半。SFAを開くと、先週のテレアポ結果が並んでいる。120件のコール、アポ獲得3件、アポ率2.5%。隣のチームも似たような数字だ。週次の営業会議では「行動量を増やしましょう」という結論が繰り返される。

展示会で集めた500枚の名刺。帰社後にリストへ登録し、翌週にメール配信する。開封率18%、クリック率1.2%、商談化ゼロ。半年後、また同じ展示会に出展し、また500枚の名刺を集める。

この風景に覚えがあるなら、あなたの会社は「コモディティ営業」に陥っている可能性が高い。

ここで、ひとつ思考実験をしてみよう。あなたの会社がClay(クレイ、GTMデータ基盤ツール)を導入した。競合のA社もClayを導入した。同じツール、同じデータプロバイダー、同じAIエージェント。ターゲットリストの作り方も、ウェビナーで教わったベストプラクティスに忠実に従っている。

3ヶ月後。あなたの会社の返信率は2.1%。A社は14.7%。

朝のSFAには相変わらず「未着手」ステータスのリードが積み上がっている。週次MTGで数字を報告するたびに、マネージャーの表情が曇る。一方、A社の営業は週に5件のホットリードだけに集中し、受注率40%を叩き出している。

ツールは同じ。手法も同じ。なのに、7倍の差がついた。

この差を説明する概念が**GTM Alpha(GTMアルファ)だ。金融の世界でα(アルファ)が「市場平均を上回るリターン」を意味するように、GTM Alphaは「競合が持たないデータを使い、競合ができない施策を実行することで得られる営業上の競争優位性」**を指す。

「ツールの使い方」ではなく「何のデータを入れるか」が勝敗を分ける——この直感は正しい。だが、直感だけでは設計できない。本記事では、GTM Alphaの概念を3段階で解き明かす。まず「なぜ同じツールを使っても差がつくのか」の構造を分析し、次にClayが提唱する「GTMの3法則」と「GTM Alphaの3つの柱」を整理する。そして最後に、日本市場でしか手に入らないデータソースを使ったAlpha獲得の具体策を提示する。

本記事の表記について

- 金額の日本円換算は1ドル=150円で計算している

- 下線付きの用語にカーソルを合わせると解説が表示される

この記事でわかること

- GTM Alphaの正確な定義: 金融のα→営業のαへの転用。なぜ「差別化」ではなく「Alpha」なのか

- GTMの3法則: ユニークさ必須・優位性は一時的・反復速度が勝敗を分けるという3つの原則

- GTM Alphaの3つの柱: ユニークなデータアドバンテージ・ハイAlphaプレイの実験・GTMエンジニアリング組織の構築

- 日本市場のAlphaソース: EDINET有報リスク・gBizINFO・業界固有データを活用した、海外企業が絶対に真似できないGTM Alpha

- Alpha獲得ロードマップ: 明日から始められる3段階の実装ステップ

基本情報

| 項目 | 内容 |

|---|---|

| GTM Alpha | 競合が持たないデータ×競合ができない施策で得られる競争優位性 |

| 提唱元 | Clay(米国GTMエンジニアリングプラットフォーム) |

| GTMの3法則 | ユニークさ必須/優位性は一時的/最速の反復が勝つ |

| 日本でのAlpha候補 | EDINET・gBizINFO・建設業許可リスト・顧問ネットワーク |

GTM Alphaの全体像——競合と同じツールを使っても、入力データが違えば出力が変わる

なぜ「同じツールを使っても勝てない」のか

冒頭で描いた「120件コール、アポ3件」の風景。そして「同じClayを使って7倍の差がつく」現象。この2つは、実は同じ構造的問題の表と裏だ。ツールを変えても、入力するデータが同じなら、結果は変わらない。ここでは、その構造を3つの角度から分析する。

ツールのコモディティ化が起きている

2024年から2026年にかけて、GTMツール市場で劇的な変化が起きた。Clay、Apollo、ZoomInfo、Sales Marker——こうしたツールの導入企業が急増し、「同じツールセットを使う企業」が増えた。

金融の世界で考えれば、事態は明快だ。全員が同じ投資信託を買えば、全員のリターンは市場平均に収束する。超過リターン(α)を得るには、「他の投資家が見ていない資産」を見つけるか、「他の投資家がやらない戦略」を実行するしかない。

GTMの世界でも同じことが起きている。Clayを導入して「従業員500名以上・IT業界・東京都」で絞り込む——この条件は、Clayを使うすべての競合企業が同じように設定できる。結果、同じ企業リストに同じようなパーソナライズメールが殺到する。受信者のメールボックスには毎朝、似たような件名のコールドメールが3通並ぶ。

「データの質」が返信率を7倍にする構造

冒頭の例に戻ろう。返信率2.1%の企業と14.7%の企業、何が違ったのか。

Clayのブログが紹介するCertemyの事例がこの差を端的に示している。Certemy(サーティミー)はコンプライアンス管理SaaSを提供する企業だ。

通常のアプローチでは、「HR部門・従業員300名以上・製造業」といった属性データでターゲティングする。だがCertemyは違った。彼らはOSHA(米国労働安全衛生局)の違反データをClayのAIエージェントで取得し、「直近6ヶ月でコンプライアンス違反を受けた企業」だけにアプローチした。

結果は明白だ。違反を受けたばかりの企業は、まさに今コンプライアンス管理の課題を抱えている。「いつか必要になるかもしれない企業」ではなく、「今まさに必要としている企業」にだけ連絡する——これがGTM Alphaの本質である。

ポイントは、Certemyが使ったツールはClayだけだということだ。競合も同じClayを使えた。しかし「OSHAの違反データをCRM連携用のシグナルとして使う」という発想は、Certemyだけが持っていた。ツールは同じでも、入力データが違えば出力が変わる。

なぜ日本市場で問題がより深刻なのか

米国では、LinkedIn Sales NavigatorやZoomInfoが「基本インフラ」として普及しており、コモディティデータの精度が高い。全員が同じ精度のデータを持っているからこそ、Alphaデータの重要性が議論される。

日本では状況がさらに複雑だ。そもそもコモディティデータの精度が低い。LinkedInの普及率が限定的で、ZoomInfoやApolloの日本企業カバレッジも不十分だ。結果として、多くの企業が「精度の低いコモディティデータ」の段階で止まっている。

日本のBtoB営業の日常を思い出してほしい。展示会で名刺を交換し、帝国データバンクやSPEEDAで企業概要を確認し、テレアポリストを作る。そのリストに「業界」「従業員規模」「地域」でフィルターをかける——これは、ツールが変わっても本質的にはコモディティデータしか使っていない。

これは裏を返せば、日本市場ではAlphaを獲得するチャンスが米国より大きいということだ。コモディティデータすらまともに活用できていない企業が大半なのだから、独自データを活用した企業は、米国以上の競争優位を得られる。

コモディティデータ vs Alphaデータ

この構造を整理すると、GTMで使われるデータは2種類に分かれる。

| 分類 | 例 | 入手難易度 | 競合との差別化 |

|---|---|---|---|

| コモディティデータ | 業界、従業員数、売上高、所在地、役職名 | 低(データベースで購入可) | ほぼゼロ |

| Alphaデータ | OSHA違反歴、有報リスク記述の変化、特定の求人パターン、補助金受給履歴 | 高(独自の収集ロジックが必要) | 極めて高い |

コモディティデータだけでターゲティングすれば、競合と同じリストが出来上がる。Alphaデータを重ねることで、「競合のリストには載っていないが、自社製品を今まさに必要としている企業」が見えてくる。

問題の構造は明らかになった。ではこのAlphaをどう設計するのか。Clayが数千社の戦略を観察して導いた「GTMの3法則」を見ていこう。

GTMの3法則——Alphaを支える3つの原則

Clayは数千社のGTM戦略を観察した結果、成功する企業に共通する3つの法則を特定した。この法則はAI時代以前から存在していたが、AIの登場によって効果が増幅された。

第1法則: ユニークでなければ、ノイズに埋もれる

汎用的なアウトリーチは、ただのノイズである。競合が知らないことを知り、競合にできないことをする企業が勝つ。

これは最も基本的な法則でありながら、最も多くの企業が違反している法則でもある。

日本のBtoB営業で典型的な違反パターンがある。年に2回出展する展示会。そこで集めた名刺リストに、毎回同じテンプレートのフォローメールを送る。「先日はブースにお越しいただきありがとうございます。弊社サービスのご案内をさせていただければ幸いです」——この文面を受け取る側は、同じ展示会に出展していた5社から、ほぼ同じ文面のメールを受け取っている。

AIがこの法則のハードルをさらに上げた。企業名や最近のニュースをメールに差し込む程度のパーソナライズは、ChatGPTで誰でも数秒でできる。「貴社の◯◯事業の拡大について拝見しました」と書かれたメールが毎日3通届くようになれば、それはもはやパーソナライズではない。「AIが全員にとって簡単にしたこと」の先を行く必要がある。

Clayのブログで紹介されている物流企業の事例が象徴的だ。この企業は特定サイズの倉庫をターゲットにしていたが、データベースの倉庫面積データは不正確で陳腐化していた。そこで彼らはGoogle Mapsの衛星画像から駐車場のスペース数をAIでカウントし、駐車場の規模から倉庫サイズを推定した。従来のデータベースよりも正確で、競合は同じアプローチを思いつかない——これが「ユニーク」の意味だ。

日本市場に置き換えてみよう。あなたがHR SaaSを販売しているとする。「従業員300名以上・製造業」でリストを作るのはコモディティだ。だが、ハローワークの求人データから「過去3ヶ月で同一職種の求人を3回以上出している企業」を抽出すればどうか。同じポジションの求人を繰り返し出しているということは、採用→離職のサイクルが回っている——つまり、人材定着に課題を抱えている可能性が高い。HR SaaSの提案が刺さる確率は、コモディティリストとは比較にならない。

第2法則: どんな優位性も永続しない

今日うまくいっている戦略は、必ず陳腐化する。競合がコピーするか、市場が飽きるからだ。

これは金融のα(アルファ)と同じ特性だ。ある投資家が「バリュー投資」で超過リターンを得ても、全員がバリュー投資を始めれば、その超過リターンは消える。GTMでも同じことが起きる。

6ヶ月前に15%だったコールドメールの返信率が、今は3%に落ちている——この現象は「優位性の減衰」と呼ばれる。AIがこの減衰を加速させている。競合が成功している戦術をコピーし、数千社に展開するまでの時間が、年単位から週単位に短縮された。

日本のBtoB営業にも同じ現象が起きている。インテントデータ(購買意欲を示す行動データ)を使ったターゲティングが登場した当初は、「自社サイトを3回以上訪問した企業」にアプローチすれば高い反応率が得られた。だが今では、Sales MarkerやFORCASの導入企業が増え、同じインテントシグナルに基づいて複数社が同時にアプローチする状況が生まれている。

つまり、「今うまくいっている手法にしがみつく企業」は必ず負ける。Alphaは維持するものではなく、常に次のAlphaを探し続けるプロセスそのものだ。

第3法則: 最速で反復する企業が勝つ

持続可能な唯一の優位性は、新しい優位性を競合より早く発見する能力である。

第2法則が「どんなAlphaも消える」と教えるなら、第3法則は「消えるスピードより速く次のAlphaを見つけよ」と教える。

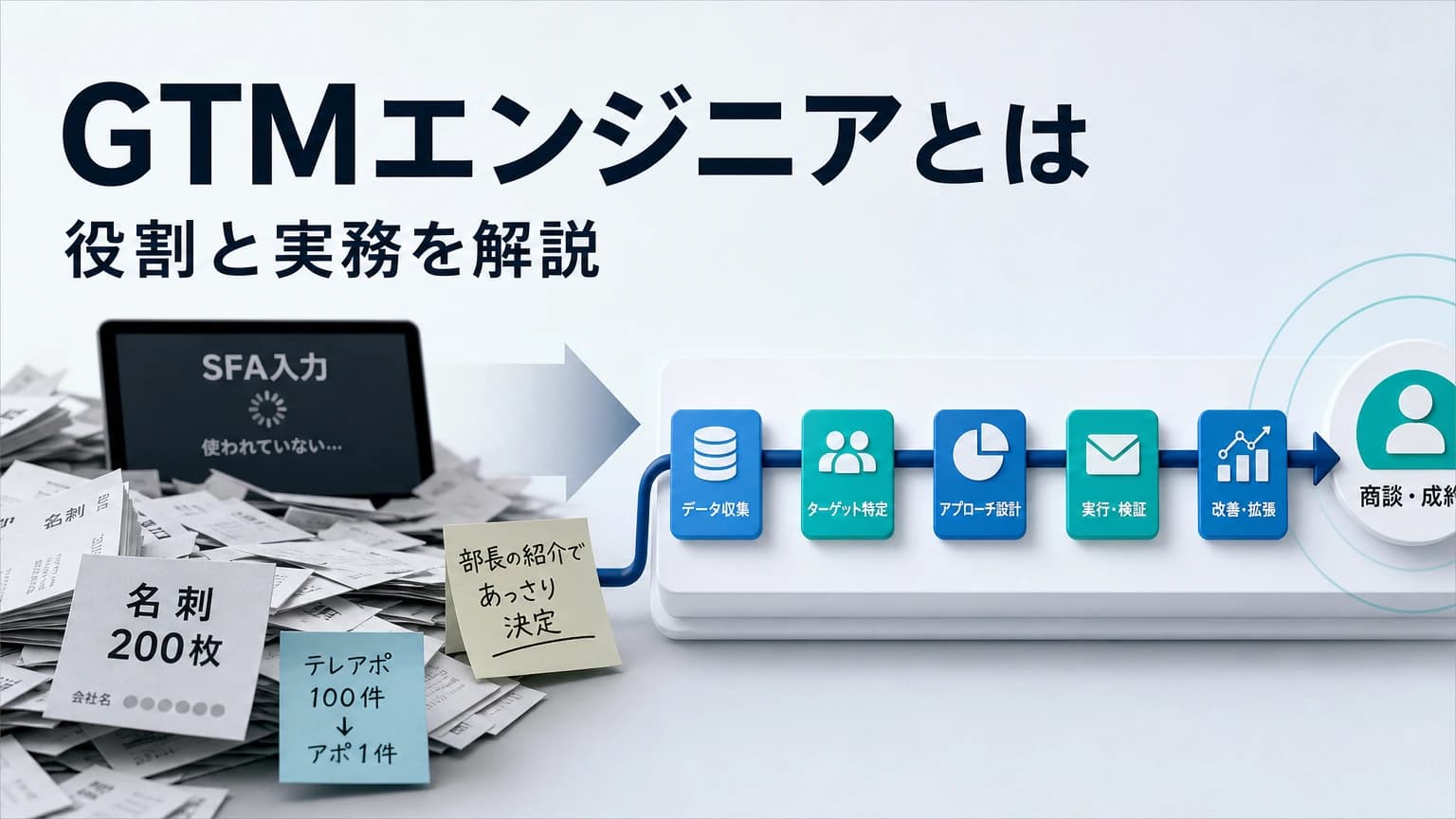

ここでGTMエンジニアリングの概念が重要になる。GTMエンジニア(Go-To-Marketエンジニア)とは、データ・AI・自動化を活用して売上を生むシステムを設計する職種だ。個々の営業担当者が手動で施策を試す体制では、四半期に数個のアイデアしかテストできない。GTMエンジニアが「仮説→データ収集→施策設計→検証」のサイクルを自動化すれば、週単位で新しい施策をテストできる。

日本企業のGTM運用では、典型的に「四半期ごとの施策見直し」が行われている。Q1に立てた施策をQ2まで実行し、Q2末にレビューして、Q3の施策を決める——このサイクルでは、年に4回しか軌道修正ができない。一方、GTMエンジニアリングを導入した組織は、毎週1つの仮説を検証する。年間52回の実験 vs 年間4回の見直し。反復速度に13倍の差がある。この差が蓄積すれば、1年後には埋められない競争優位が生まれる。

Anthropic社(Claudeの開発元)のSales Opsチームでは、Clayでリードのエンリッチメントからスコアリング、ルーティングまでを自動化し、営業担当者は有望な見込み客との対話に集中している。このような体制が「反復速度の最大化」の実例だ。

GTMの3法則——ユニーク・減衰・反復速度

3つの法則は「なぜAlphaが必要なのか」を構造的に説明する。では、具体的にAlphaをどう獲得するのか。次のセクションでは「GTM Alphaの3つの柱」——実際の獲得方法論に踏み込む。

GTM Alphaの3つの柱

GTMの3法則が「なぜAlphaが必要なのか」を説明するのに対し、GTM Alphaの3つの柱は「どうやってAlphaを獲得するのか」を示す。

柱1: ユニークなデータアドバンテージ

業界・規模・役職のような「全員が見ているデータ」ではなく、独自のシグナルを発掘する。

Alphaデータを見つけるための手順は以下のとおりだ。

Step 1: 自社の顧客を深く理解する

営業チームに「商談前に何を手動で調べているか」を聞く。その「手動の調査」が、自動化すべきAlphaデータの候補だ。たとえば「この企業、最近セキュリティの求人出してるな」と営業が感じるなら、求人情報の変化がAlphaシグナルになる。

Step 2: Alphaシグナルをデータポイントに変換する

営業の直感をAIで自動取得できるデータポイントに落とし込む。以下は実際の活用例だ。

| 企業 | Alphaデータ | 取得方法 |

|---|---|---|

| Certemy(コンプライアンス管理SaaS) | OSHA(労働安全衛生局)違反履歴 | 政府公開データ × AIエージェント |

| Supermetrics(マーケティング分析ツール) | ブランドかエージェンシーかの識別 | Webサイト解析 × AI分類 |

| Rutter(Eコマース統合API) | カンファレンス参加者リストの公開タイミング | イベントサイト監視 |

| Cake.ai(AI導入コンサルティング) | AIエンジニアチームの人数(2-5人=最適ターゲット) | 求人情報 × LinkedIn |

| 物流企業 | 衛星画像の駐車場スペース数 | Google Maps × AI画像解析 |

Step 3: タイミングデータを重ねる

Alphaデータが最も強力になるのは、時間軸と組み合わせた時だ。「セキュリティの求人を出している企業」は常にいるが、「先月初めてセキュリティの求人を出した企業」は、今まさにセキュリティ強化を決断したばかりである。この変化のタイミングを捉えることで、コモディティデータでは不可能な精度でアプローチできる。

柱2: ハイAlphaプレイの実験

ユニークなデータを手に入れたら、それを活かした「ユニークな施策(プレイ)」を設計する。

データを持っているだけではAlphaにならない。そのデータを使って「競合ができないアプローチ」を実行して初めてAlphaが生まれる。

| 企業 | データ | プレイ | 結果 |

|---|---|---|---|

| Verkada(監視カメラSaaS) | 見込み客の企業情報 | 企業ごとにカスタマイズされたランディングページを数千件自動生成 | 汎用LPの2倍以上のCVR |

| Rippling(HR SaaS) | Google Mapsの住所データ | 通勤距離から最もアクティブなオフィスを特定→ダイレクトメール送付 | オフィス不在による無駄を大幅削減 |

| AIマーケットプレイス | Amazon/Walmartの商品トレンド | トラクションが出始めた出品者に自動でアプローチ。海外出品者にはAI翻訳で現地語対応 | 競合が気づく前にアプローチ完了 |

ポイントは、これらの施策がいずれも「データ」と「アクション」が直結している点だ。データを取得して営業にリストを渡すのではなく、データの取得から施策の実行までが自動化されたワークフローとして設計されている。

日本の文脈で考えると、たとえば建設業向けのSaaSを販売する企業が、国土交通省の建設業許可リスト(約48万社)から「許可の更新が迫っている企業」を自動検出し、「許可更新に必要なコンプライアンス管理機能」を訴求するメールを自動送信する——これも立派なハイAlphaプレイだ。競合がターゲティングに「建設業」と入力しているあいだに、「許可更新時期」というタイミングデータを加えることで、反応率は劇的に変わる。

そして、どんなに優秀なプレイも永続しない(第2法則)。だからこそ、プレイの「実験と改善」を継続的に回す仕組みが必要になる。四半期に1回の施策見直しでは遅い。毎週、新しい仮説を検証する——この速度がAlphaを維持する条件だ。

柱3: GTMエンジニアリング組織の構築

Alpha獲得を一過性のプロジェクトではなく、組織の「常時稼働機能」として設計する。

従来の営業組織は「流れ作業」だ。SDR(Sales Development Representative=インサイドセールス担当者)がリストを作り、AE(Account Executive=クロージング営業担当者)が商談をクローズし、RevOps(Revenue Operations=営業インフラ担当)がCRMを管理する。

この分業モデルの問題は、発見が組織に広がらない点にある。あるSDRが「Series Bの資金調達を完了し、かつカスタマーサクセスの求人を出している企業に、コンプライアンスリスクのメッセージを送ると反応率が高い」と気づいたとする。しかし、この発見は他のSDRに共有されない。RevOpsチームもCRM管理に忙しく、このインサイトを仕組み化しない。

日本企業でも同じことが起きている。エース営業が独自の「商談前チェックリスト」を持っていて、決算短信の数字や業界紙の記事をチェックしてから電話をかけている。しかし、そのノウハウは属人的に留まり、チーム全体には展開されない。月次の営業会議で「○○さんのやり方を真似しましょう」と言われても、具体的な手順が仕組み化されていないため、結局は実行されない。

GTMエンジニアリング組織は、この「発見→仕組み化→展開」のサイクルを制度化する。

| 要素 | 従来モデル | GTMエンジニアリングモデル |

|---|---|---|

| データ活用 | CRMの属性データで絞り込み | 独自シグナルの収集→スコアリング→自動ルーティング |

| 施策の実験 | 四半期ごとにマーケ部門がキャンペーンを企画 | 毎週、仮説→データ取得→テスト→検証のサイクルを回す |

| インサイトの展開 | 個人の成功体験が属人的に留まる | 成功パターンを自動ワークフローとして全組織に展開 |

| 役割 | SDR・AE・RevOpsの分業 | GTMエンジニアが「データ×技術×営業」を統合 |

GTM Alphaの3つの柱——データ・プレイ・組織

3つの柱は「何をすべきか」を示す。だが日本のBtoB企業にとって最も重要な問いは、「具体的にどのデータを使えばいいのか」だろう。次のセクションでは、海外企業が構造的に真似できない、日本市場固有のAlphaソースに踏み込む。

日本市場のGTM Alpha——海外企業が絶対に真似できないデータ

ここまではClayが提唱する概念を整理した。だが、日本のBtoB企業にとって最も重要な問いは、「日本市場で、どこにAlphaがあるのか」だ。

答えは明快だ。日本政府が無料で公開しているデータに、世界のGTMツール企業が一切手を付けていない領域がある。

日本独自のAlphaデータソース

| データソース | 提供元 | 内容 | Alpha度 | 理由 |

|---|---|---|---|---|

| EDINET 有報リスク | 金融庁 | 上場企業の「事業等のリスク」記述 | ★★★ | 毎年更新。前年比の変化でタイミングを捉えられる |

| gBizINFO | 経済産業省 | 法人番号・許認可・補助金受給 | ★★★ | 補助金受給=投資に前向きなシグナル |

| 建設業許可リスト | 国土交通省 | 約48万社の許可情報 | ★★☆ | 業界特化のターゲティングに有効 |

| 宅建業者リスト | 各都道府県 | 約12.7万業者の免許情報 | ★★☆ | 不動産テック企業のAlphaソース |

| 適時開示 | 東京証券取引所 | M&A・業務提携・人事異動 | ★★★ | リアルタイムの企業イベントデータ |

| 特許公報 | 特許庁 | 技術投資の方向性 | ★★☆ | 特定技術に投資している企業の特定 |

なぜこれがAlphaなのか。 Clayのデータプロバイダーは150以上あるが、いずれも米国・英語圏のデータがメインだ。EDINETの有価証券報告書をXBRL(eXtensible Business Reporting Language=企業の財務報告をコンピュータが読み取れる形式にした標準規格)で解析し、「事業等のリスク」欄のテキストを自然言語処理で分類する——この仕組みを持つGTMツールは、世界に存在しない。

つまり、日本の公開データを活用したGTM Alphaは、海外企業が構造的に真似できない。これは「言語の壁」以上の問題だ。データの形式(XBRL)、法制度(金融商品取引法に基づく開示義務)、データの粒度(企業ごとのリスク記述)——すべてが日本固有の構造に依存している。

具体例1: セキュリティSaaS企業のAlpha獲得

実際にどう使うのか。あなたの会社がセキュリティSaaSを売っているとして、日本独自のAlphaを設計してみよう。

従来のアプローチ(コモディティデータ):

- 業界: IT・製造・金融

- 従業員: 500名以上

- 地域: 東京都

- → 数千社のリスト。競合も同じリスト

Alphaアプローチ(日本独自データ):

- EDINET有報リスクの時系列解析: 前年の有報に「サイバーセキュリティ」の記述がなかったが、今年新たに追加された企業を抽出。変化=課題認識の高まりを捉える

実際の有報リスク記述の変化例を見てみよう。

| 項目 | 2024年3月期の記述 | 2025年3月期の記述 |

|---|---|---|

| 企業X(製造業) | 記載なし | 「サイバー攻撃による生産ラインの停止リスクが顕在化しており、情報セキュリティ体制の強化が急務」 |

| 企業Y(小売業) | 「個人情報の管理について社内規程を整備」 | 「ランサムウェア攻撃による顧客データ漏洩リスクに対し、外部専門機関との連携を含む抜本的な対策を検討」 |

企業Xは今年初めてサイバーセキュリティを「リスク」として認識した。企業Yは従来の漠然とした記述から具体的な脅威名と対策方針に踏み込んだ。いずれも、「今期、セキュリティ予算が動く可能性が高い企業」のシグナルだ。

- gBizINFOの補助金データ: DX関連の補助金(IT導入補助金、ものづくり補助金等)を受給している企業を抽出。補助金受給=IT投資に前向きなシグナル

補助金データの活用シナリオをもう少し具体的に考えよう。IT導入補助金は年に複数回の公募がある。採択結果はgBizINFOに反映される。「前回の公募でIT導入補助金を受給した企業」は、すでにIT投資の意思決定を行い、かつ公的資金を活用する体制が整っている。つまり、次のIT投資案件にも前向きな可能性が高い。セキュリティSaaSの提案にとっては、「IT投資への抵抗感が低い」ことが事前に分かるシグナルとなる。

- 適時開示のM&A情報: 直近3ヶ月でM&Aを発表した企業を抽出。統合後のシステム統合にはセキュリティの再設計が必要になる

この3つのデータを重ねると、「セキュリティリスクを新たに認識し、IT投資に前向きで、かつシステム統合の需要がある企業」だけが残る。数千社のリストが数十社に絞られるが、そのうちの半数以上が「今まさに検討している企業」だ。

これがData Waterfall(データウォーターフォール)の日本版だ。Data Waterfallとは、複数のデータプロバイダーを「滝」のように重ね、段階的にリードを濃縮していく手法である。米国ではClay + ZoomInfo + Apolloを重ねるのが一般的だが、日本ではEDINET + gBizINFO + 自社データという実質無料のData Waterfallが構築できる。

具体例2: HR SaaS企業のAlpha獲得

セキュリティSaaS以外の業種でも同じフレームワークが適用できる。HR SaaS(人材管理クラウド)を販売するケースを見てみよう。

Alphaアプローチ:

- EDINET有報リスクの時系列解析: 「人材確保」「人的資本」「離職率」といったキーワードが前年比で新たに追加、または記述量が大幅に増加した企業を抽出。2023年3月期から上場企業に義務化された人的資本開示の記述は、企業のHR課題を定量的に読み取れるAlphaソースだ

- ハローワーク求人データ: 同一職種の求人を過去3ヶ月で3回以上出している企業を抽出。繰り返しの求人は「採用しても定着しない」シグナルであり、HR SaaSの提案ニーズが高い

- gBizINFOの認定データ: 「くるみん認定」(子育て支援)や「えるぼし認定」(女性活躍推進)を未取得の企業を抽出。認定取得を目指す企業は、人事制度の整備にHRツールの導入を検討する傾向がある

このように、業種が変わっても「有報リスクの変化」+「行動シグナル」+「公的データ」の3層構造は同じだ。自社の製品カテゴリに関連するキーワードを有報から抽出し、行動シグナル(求人、補助金、認定取得等)を重ねれば、どの業種でも日本独自のData Waterfallを構築できる。

なぜ「顧問ネットワーク」もAlphaになるのか

日本のBtoB営業には、米国にはない独自のAlphaソースがもう一つある。顧問ネットワークだ。

「顧問」は日本固有の商慣習であり、元役員・元業界幹部が複数企業の経営顧問として関与する仕組みだ。LinkedInの普及率が低い日本市場では、「誰が誰を知っているか」という関係性データが、米国でのLinkedInプロフィール以上のAlphaになる。

ただし、従来の顧問営業は「属人的」だった。顧問が誰を知っているかは、顧問本人の記憶に依存し、デジタル化されていなかった。

GTMエンジニアリングの発想で顧問ネットワークをAlpha化する方法は以下だ。

- データで「誰に会うべきか」を特定: EDINET × gBizINFOのData Waterfallで、最も確度の高いターゲット企業を特定

- 顧問ネットワークで接点を作る: 特定されたターゲット企業のキーパーソンに、顧問経由でアプローチ

- フィードバックをデータに還元: 商談結果をデータとして蓄積し、次のターゲティングに反映

データ(ロジック)× 顧問(関係性)= ハイブリッドGTM Alpha。この組み合わせは、Clayでは絶対に再現できない。米国にはそもそも「顧問」という仕組みがないからだ。

日本市場のGTM Alpha——EDINET × gBizINFO × 顧問ネットワーク

日本独自のデータソースとその活用パターンが明らかになった。では、実際にどう着手すればいいのか。次のセクションでは、明日から始められる3段階のロードマップを示す。

Alpha獲得の実装ロードマップ

概念は理解した。では、明日から何をすればいいのか。GTM Alphaの獲得を3段階で設計する。

なぜ「ロードマップ」が必要なのか

GTM Alphaの概念は魅力的だが、多くの企業が「面白い考え方だが、何から始めればいいかわからない」という状態で止まる。理由は単純で、Alpha獲得は段階的に積み上げるものであり、いきなり高度なData Waterfallを構築しようとしても失敗するからだ。

以下の3段階は、GTMエンジニアリングの導入を支援するなかで、最も再現性が高かったアプローチだ。

Stage 1: コモディティデータの棚卸し(1-2週間)

まず、自社が現在使っているデータの「Alpha度」を診断する。

やること:

- 現在のターゲティング条件を書き出す

- その条件が「競合も同じ条件で絞っていないか」を検証する

- 営業チームに「商談前に手動で調べていること」をヒアリングする

判定基準:

- 業界・従業員数・売上高だけ → コモディティ100%。Alphaゼロ

- 「最近の求人情報」「ニュースの変化」を手動で確認 → Alpha候補あり

- 「独自のデータソースで絞っている」 → すでにAlpha獲得済み

多くの企業はこの段階で「自社のターゲティングは100%コモディティデータだった」と気づく。それは悪いことではない。改善余地が大きいということだ。

Stage 2: 日本独自のData Waterfall構築(2-4週間)

最小構成で始める。 以下は、実際の処理フローの概要だ。

処理フロー:

-

gBizINFO APIで法人データを取得: 法人番号をキーにして、補助金受給・許認可データを取得する。gBizINFO APIは無料で公開されており、法人番号さえあればJSON形式でデータが返ってくる。Pythonのrequestsライブラリで数十行のスクリプトを書けば、自社のCRMに登録されている全企業の補助金受給状況を一括取得できる

-

EDINET APIで有報リスク記述を抽出: EDINET APIも無料で利用可能だ。証券コードから有報のXBRLファイルをダウンロードし、「事業等のリスク」セクションを抽出する。処理の流れとしては、まず有報の書類一覧を取得し、次に該当のXBRLファイルをダウンロードし、そこからリスク記述部分をパースする。自社の製品カテゴリに関連するキーワード(例: 「サイバーセキュリティ」「人材不足」「サプライチェーン」)でテキストをフィルタリングする

-

前年比の変化を検出: 前年と今年の記述を比較し、今年新たに追加されたリスクキーワードを持つ企業を特定する。テキスト差分の検出にはPythonのdifflibやLLMを活用できる。「前年には存在しなかったキーワードが今年出現した」企業をフラグ付けし、優先度の高いリードとしてリスト化する

-

スコアリングとCRM連携: 上記3つのデータを統合し、各企業に「Alpha度スコア」を付与する。たとえば「有報リスク変化あり(+3点)」「補助金受給あり(+2点)」「M&A発表あり(+2点)」のように重み付けし、合計スコアが高い順にCRMへ連携する

この4ステップで、「自社製品のカテゴリに関する課題を新たに認識し、かつ投資に前向きな企業」のリストが出来上がる。高額なツールの導入は不要だ。PythonスクリプトとAPIキー(無料)があれば明日から始められる。

Stage 3: プレイの設計と反復(継続)

Data Waterfallからリストが出たら、そのリストに最適化されたプレイを設計する。

設計のポイント:

- リストの特性に合わせたメッセージ: Alphaデータから読み取ったインサイトを、初回接触のメッセージに反映させる

- 顧問ルートとデジタルルートの使い分け: 年商100億円以上の企業は顧問経由、それ以下はデジタルアプローチと切り分ける

- 週次の検証サイクル: 毎週、リストの精度と施策の反応率を確認し、フィルタ条件やメッセージを調整する

メッセージの具体例を見てみよう。

コモディティメッセージ(よくある例):

「貴社のDX推進に貢献できるセキュリティソリューションのご提案です。ぜひ一度お打ち合わせのお時間をいただけませんでしょうか」

Alphaメッセージ(有報リスク変化を活用した例):

「貴社の2025年3月期有価証券報告書を拝読し、サイバーセキュリティリスクへの対応方針が新たに記載されていることを確認いたしました。特にサプライチェーン経由の攻撃リスクへの対策は、同業界の上場企業の間でも急速に優先度が上がっています。この領域で3社の導入実績がある弊社のアプローチについて、15分ほどお時間をいただけないでしょうか」

前者は無視される。後者は「自社の有報を読んで、具体的な課題を理解した上で連絡してきた」と受信者に伝わる。この差がAlphaメッセージの効果だ。

重要なのは「完璧なリスト」を作ることではなく、「改善サイクルを回し続けること」だ(第3法則)。最初のリストが外れても問題ない。3回反復すれば、自社にとってのAlphaシグナルが見えてくる。

各Stageの所要期間と必要リソースの目安:

| Stage | 期間 | 必要スキル | コスト |

|---|---|---|---|

| Stage 1 | 1-2週間 | 営業ヒアリング能力 | ¥0 |

| Stage 2 | 2-4週間 | Python基礎、API利用経験 | ¥0(APIは無料) |

| Stage 3 | 継続 | GTMエンジニアリングの知識 | ツール費用は規模による |

Stage 1とStage 2は、専任のGTMエンジニアがいなくても、営業企画やマーケティング担当者が兼務で始められる。Stage 3で本格的にスケールさせる段階で、専任のGTMエンジニア採用を検討するのが現実的だ。

GTM Alphaの限界と注意点

ここまでGTM Alphaの有効性を論じてきた。「自社でもできそうだ」と感じた方もいるだろう。だが、実装に入る前に知っておくべき構造的な限界がある。

Alphaは「消える」前提で設計する

第2法則が教えるとおり、どんなAlphaも永続しない。EDINETの有報リスク解析が効果的だと分かれば、いずれ競合も同じ手法を始める。1年後には同じデータを使う企業が3社、5社と増え、Alphaが消える。

だからこそ、「今のAlphaを最大限活用しつつ、次のAlphaの種を探し続ける」という二重構造が必要だ。現在のData Waterfallの精度向上と、次の新しいデータソースの探索を、並行して走らせる。

プロダクトがなければAlphaは無意味

GTM Alphaは「正しい企業に、正しいタイミングで届く」ことを保証するが、届いた先で価値を提供できるかはプロダクト次第だ。どんなにターゲティングが正確でも、製品が市場のニーズに合っていなければ成約には至らない。

Clayのブログでも「仕掛け(gimmick)はすぐに色褪せるが、見込み客の課題に他の誰よりも的確に応えること——これは常に有効だ」と述べられている。GTM Alphaはあくまで「届け方」の優位性であり、「届けるもの」の品質が前提条件だ。

EDINETデータの「実際の使いにくさ」

EDINETを「Alphaソースの本命」として紹介したが、実務上のハードルも正直に述べておく必要がある。

XBRLの解析は想像以上に面倒だ。 EDINETのXBRLファイルはネスト構造が深く、タクソノミ(データの分類体系)が複雑だ。「事業等のリスク」セクションを抽出するだけでも、タグの構造を理解し、適切な要素を指定する必要がある。さらに、企業ごとにXBRLのタグ付けにばらつきがあり、完全に統一されたフォーマットでは取得できない。

前年比較の煩雑さも課題だ。 前年と今年で章立てが変わっていたり、文言を微修正しているケースがある。単純なテキスト差分では「実質的な変化」と「表現の揺れ」を区別できない。LLMを使えば精度は上がるが、有報の全文をLLMに投入するとコストがかかる。

現実的な対処法としては、まずEDINET APIから「書類管理番号」で有報を特定し、XBRLではなくHTMLフォーマットでダウンロードする方法がある。HTMLから「事業等のリスク」セクションをスクレイピングする方が、XBRLをパースするよりも実装が容易だ。そのうえで、LLMに前年比較を行わせれば、実用的な精度で変化検出ができる。

完璧なシステムを最初から構築しようとするのではなく、まずは「自社の製品カテゴリに関連するキーワードが新たに出現したか」という単純なチェックから始めるのが現実的だ。

データ倫理と法規制

EDINET・gBizINFOの活用は公開データの正当な利用だが、個人情報の取り扱いには注意が必要だ。有報から企業名を取得し、その企業のキーパーソン個人にアプローチする際には、個人情報保護法および電子メール規制(特定電子メール法)を遵守する必要がある。

特に、オプトイン(事前同意)なしのコールドメールは日本では厳しく規制されている点に留意すべきだ。特定電子メール法では、受信者の事前同意なく広告宣伝メールを送信することは原則として違反となる。例外として「取引関係にある場合」や「名刺交換した場合」があるが、有報から抽出したターゲット企業への初回コールドメールは、これらの例外に該当しない可能性が高い。

現実的には、まず電話でのアプローチ、展示会・セミナーでの接点作り、または顧問経由の紹介を通じてオプトインを取得し、その後にメールでのフォローアップに移行するのが法的にも営業的にも適切だ。Alphaデータは「誰に連絡すべきか」を教えてくれるが、「どの手段で連絡すべきか」は法規制と商慣習に従う必要がある。

FAQ

GTM Alphaとは何ですか?

GTM Alpha(GTMアルファ)とは、金融用語の「α(超過リターン)」をGTM(Go-To-Market=市場参入・売上獲得戦略)に応用した概念である。競合が持たないデータを使い、競合ができない施策を実行することで得られる営業上の競争優位性を指す。Clayが提唱した概念で、日本語では「GTMアルファ」と表記する。

GTMの3法則とは何ですか?

GTMの3法則とは、Clayが数千社のGTM戦略を観察して特定した成功原則である。第1法則「ユニークでなければノイズに埋もれる」、第2法則「どんな優位性も永続しない」、第3法則「最速で反復する企業が勝つ」の3つからなる。AIの登場によってこれらの法則の効果は増幅されている。

Data Waterfallとは何ですか?

Data Waterfall(データウォーターフォール)とは、複数のデータプロバイダーを「滝」のように重ね、段階的にリードの精度を高めていく手法である。米国ではClay + ZoomInfo + Apolloが典型的な組み合わせだが、日本ではEDINET + gBizINFO + 自社データで実質無料のData Waterfallを構築できる。

日本市場でGTM Alphaを獲得するにはどうすればよいですか?

日本市場でのGTM Alpha獲得には、EDINET(金融庁の有報データベース)とgBizINFO(経産省の法人情報データベース)の活用が有効である。有報の「事業等のリスク」欄の時系列変化で課題認識の高まりを検出し、gBizINFOの補助金受給データでIT投資への前向きさを判定する。この2つのデータを組み合わせることで、「今まさに自社製品を必要としている企業」を特定できる。

GTM Alphaの実装にはどのくらいのコストがかかりますか?

Stage 1(コモディティデータの棚卸し)とStage 2(Data Waterfall構築)は実質ゼロ円で始められる。EDINET API・gBizINFO APIはいずれも無料で公開されており、Pythonの基礎知識があれば2-4週間で最小構成のData Waterfallが構築可能だ。Stage 3(プレイの設計と反復)で本格的にスケールする際に、ツール費用や専任GTMエンジニアの人件費が必要となる。

まとめ

冒頭の問いに戻ろう。月曜の朝、SFAに並ぶ「アポ率2.5%」の数字。展示会の名刺500枚から商談化ゼロの現実。これらは「行動量」の問題ではなく、「データの質」の問題だ。

GTM Alphaの本質は、ツールの選び方ではなく、データの見つけ方にある。

全員がClayを使う世界では、Clayの「使い方」は差別化にならない。差別化を生むのは「Clayに何を入力するか」——つまり、独自のデータアドバンテージだ。

日本市場には、世界のGTMツール企業が手をつけていないAlphaソースが眠っている。EDINET、gBizINFO、適時開示、顧問ネットワーク——これらは無料、または低コストで利用できるにもかかわらず、GTMのデータソースとして体系的に活用している企業はほぼ存在しない。

始め方は単純だ。まず自社のターゲティング条件を書き出し、「この条件は競合も同じか?」と問う。答えがYesなら、それはAlphaではない。次に、営業チームに「商談前に何を手動で調べているか」を聞く。その手動の調査が、自動化すべきAlphaシグナルの候補だ。

GTM Alphaは、発見し、活用し、消えたら次を探す——このサイクルを回し続ける営業戦略の設計思想そのものである。

関連記事

この記事の著者

中村 知良

代表取締役

早稲田大学卒業後、ソフトバンク株式会社にてAI活用やCEO直下案件のプロジェクトマネージャーに従事。その後、不動産スタートアップPit in株式会社の創業、他スタートアップでの業務改善・データ活用を経験後、2023年10月、株式会社ネクサフローを創業し代表取締役CEO就任。

次に読む

あわせて読みたい

GTM戦略とは?BtoB売上を生むGo-To-Market設計の全体像

GTMを、売上を生む仕組みの設計図として整理。シグナル起点の営業、GTMエンジニアリング、紹介チャネルをどう組み合わせるか、日本で使える公開データ、改善サイクルの設計ポイントをまとめる。

2026/04/15

GTM戦略Go-To-MarketBtoBマーケティング

GTMエンジニアとは?営業 workflow を設計する役割の読み方

GTMエンジニアを、営業 workflow を設計し続ける役割として読み解く。data foundation、signal 設計、activation、日本で使うデータ層の置き換え先を整理する。

GTMエンジニアセールステック

インテントセールスとは?Sales Marker・FORCAS・6senseの実力と限界

インテントセールスの定義・仕組みをツール比較表付きで解説。Sales Marker(月間検索4,400)、FORCAS、6senseの機能・限界を第三者視点で検証。Reddit/Xの海外ユーザーの生の声も紹介。

インテントセールスSales Marker