スタートアップ分析

Nexthop AIとは?AIネットワーク製品群と導入論点を整理

13分で読める|2026/04/15|

AIスタートアップインフラ

この記事の要約

Nexthop AIを、AIクラスタのどのネットワーク層を担う会社なのか、どの製品群とNOSの選択肢があるのか、disaggregated spineをどう読むべきかという観点から整理するガイド。

Nexthop AI を理解するときに先に見るべきなのは、派手な見出しや会社の勢いそのものではありません。AI クラスタのどのネットワーク層を担うのか、どのソフトウェア運用を前提にしているのか、どこまで customer-specific な設計を引き受ける会社なのかです。

このページでは、Nexthop AI の公式 Platforms、company press release、product press release、datasheet、whitepaper を起点に、Nexthop AI を「どの場面で検討する製品群か」という観点で整理します。

この版の前提

- 会社の出来事は後半の dated snapshot に寄せ、前半は product surface と導入判断に残りやすい論点を優先して整理します

- 型番、熱設計、optics、software image の詳細は改定されうるため、案件ごとに vendor docs を見直してください

- public material だけでは market share や実導入規模までは確定できないため、本文では official claim と inference を分けて扱います

この記事でわかること

- Nexthop AIをどう読むべきか: 汎用 switch vendor ではなく、AI/Cloud 向けの co-development partner として見る

- 製品群の見分け方: scale-out、scale-across、front-end をどの platform が担うか

- software posture: SONiC / FBOSS / BYoNOS / Nexthop NOS をどう読み分けるか

- Disaggregated Spine の意味: chassis 置き換えの architectural claim をどこまで信じるか

- 導入前の確認点: NOS ownership、thermal headroom、optics validation、custom engineering scope

基本情報

| 項目 | 内容 |

|---|---|

| 会社名 | Nexthop AI |

| 創業者 | Anshul Sadana |

| 本社 | 米国カリフォルニア州サンタクララ |

| 主な公開領域 | scale-out、scale-across、front-end network |

| software の考え方 | SONiC、FBOSS、BYoNOS、Nexthop NOS |

| 主な reference | Platforms、product datasheet、company / product press release、whitepaper |

| 見極めたい論点 | どの fabric 層を任せるか、NOS を誰が握るか、光学系の検証責任をどこに置くか |

Nexthop AIの全体像:AI特化ネットワーク企業のポジショニング

Nexthop AIの全体像:AI特化ネットワーク企業のポジショニングまず会社の見方を揃える

Nexthop AI の公式 site は、自社を「the world’s largest cloud operators 向けに最も効率的な AI infrastructure を作る会社」と位置づけています。さらに company launch press release では、hyperscaler 向けに customer specification に合わせた hardware、選択した network operating system、pre-tested optics / cables を組み合わせるモデルを明示しています。

この書き方から分かるのは、Nexthop AI を一般向けの汎用スイッチ会社として読むより、AI cluster を組む事業者向けの design partner として読む方が近いということです。公開資料の重心も、一般的なキャンパスネットワーク機能ではなく、AI cluster の power efficiency、deployment velocity、open networking、optics validation に置かれています。

Nexthop AI を理解するうえで、先に押さえたいのは次の 3 点です。

- 同社は単一の「AI スイッチ」ではなく、scale-out / scale-across / front-end という層ごとの portfolio を打ち出している

- hardware 単体より、NOS choice と optics / telemetry まで含めた運用面を差別化ポイントにしている

- public material は hyperscaler / neocloud 向けを中心に書かれており、中堅 IT 事業者向けの一般論として読むとズレやすい

製品マップ: どの network 層を誰が担うのか

Platforms page は、AI data center の network を 4 つの役割で説明しています。

| 層 | 役割 | 公開ページでの説明 |

|---|---|---|

| scale-out | cluster 内の大量データ交換と同期学習 | high radix、高性能、低 latency、lossless connectivity |

| scale-up | rack 内の XPU 間接続 | rack 内の低 latency、lossless connectivity |

| scale-across | cluster をまたぐ接続 | data center cluster 間の高性能接続 |

| front-end | cluster と user / storage / internet の接続 | inference や学習向け AI service の外向き接続 |

このうち、public product page で具体的に前面に出ているのは主に 4000、4200、5000 の 3 series です。

Nexthop 4000 Series

公式 Platforms page では、4000 Series を up to 51.2T throughput、high density 800G switching、enhanced QoS / load-balancing を備えた fixed-form-factor platform と説明しています。用途は scale-out、scale-across、front-end network です。

読み方としては、AI fabric の中核になる高密度 switching layer を狙った製品群と考えるのが自然です。AI training cluster の back-end 側だけでなく、front-end 側の east-west / north-south をまとめたいケースでも検討対象に入りえます。

Nexthop 4200 Series

4200 Series は up to 102.4T throughput、1.6T switching in 2RU、advanced load balancing / real-time telemetry / high radix ECMP を前面に出しています。用途は AI back-end と front-end network です。

ここで重要なのは、「密度」と「telemetry」を同時に押している点です。AI network では port count だけでなく、輻輳、loss、optics、queue 挙動をどう観測するかが運用品質を左右します。4200 Series は、単に帯域を増やす箱というより、大規模 fabric を運用するための観測面込みの platform として読む方が実態に近いでしょう。

Nexthop 5000 Series

5000 Series は、公式 page と NH-5000 datasheet の両方で、25.6T throughput、deep-buffer、VOQ-based architecture、line-rate encryption on every port、large routing / ACL tables を打ち出しています。主用途は data center interconnect と scale-across です。

特に NH-5000 datasheet では、32GB packet buffer、MACsec on all ports、400/800 GbE ZR optics、expanded route scale が明示されており、単一 cluster 内の leaf/spine よりも、cluster 間接続や long-reach を含む設計を意識した製品だと読み取れます。

software posture: open networking をどう扱っているか

Nexthop AI の public material が他社と少し違うのは、hardware より前に software choice を押し出しているところです。Platforms page では SONiC / FBOSS / BYoNOS を明示し、product press release では hyperscaler 向けに customer が選ぶ SONiC / FBOSS を動かせること、NeoCloud 向けには Nexthop NOS powered by SONiC を用意することを説明しています。

NH-5000 datasheet も、switch が ONIE をプリインストールし、community SONiC と Nexthop NOS を支える前提で書かれています。つまり Nexthop AI は「hardware を売って終わり」ではなく、どの NOS を誰が ownership するかまでを設計論点に含めています。

ここでの読み分けは次の通りです。

- 既に SONiC / FBOSS の運用能力がある事業者: hardware / optics / custom engineering を主に評価する

- software まで turnkey に寄せたい事業者: Nexthop NOS の運用境界、upgrade 方式、telemetry integration を評価する

- BYoNOS を前提にする事業者: vendor 側がどこまで validation を担うかを先に確認する

AI network では port speed よりも、image 管理、optics qualification、障害切り分け、telemetry pipeline の ownership が後で効きます。Nexthop AI の資料を読むときも、どの NOS を動かせるかより、その NOS を誰が責任を持って回すのかを先に問う方が実務的です。

Disaggregated Spine をどう読むか

Nexthop AI の whitepaper Disaggregated Spine for Modern AI Networks は、従来の monolithic chassis spine を、scale-across leaf と scale-across spine に分ける構成を提案しています。whitepaper 上の reference implementation では、NH-4010 を scale-across leaf、NH-5010 を scale-across spine に当てています。

この whitepaper の主張は明快です。

- DCI 向け要件と intra-data-center 向け要件を一つの chassis に押し込めるより、tier を分けた方が silicon、buffer、optics、routing scale を別々に最適化しやすい

- open networking software を乗せやすく、proprietary fabric 依存を下げられる

- whitepaper の前提条件では、legacy chassis-based system と比べて cost / power をおよそ 30% 下げられる

ただし、この 30% は universal truth として読むべきではありません。whitepaper 自体が、silicon class、optics、oversubscription ratio、traffic domain の置き方に依存する設計ケースとして提示しています。読むときは「Nexthop AI がどんな architecture に賭けているか」を把握する材料にはなりますが、そのまま自社案件の TCO 改善率として持ち込むのは危険です。

商談や設計レビューで使うなら、少なくとも次は確認したいところです。

- scale-across leaf と spine を分ける前提が、自社の traffic pattern に合うか

- deep-buffer と MACsec が必要な区間はどこか

- LPO / LRO / ZR optics を含む電力前提が whitepaper とどれだけ近いか

- chassis を外した時に運用 team の troubleshooting が本当に楽になるか

Dated Company Snapshot

ここからは「会社の今の勢い」を示す話ではなく、公開資料時点の snapshot として整理します。

- 2025年3月25日: Nexthop AI は stealth からの company launch を発表し、公式 press release で $110M の funding を公表しました

- 2026年3月10日: 同社は公式 press release で $500M Series B と $4.2B valuation を発表しました

- 同日の product press release では、scale-out / scale-across / front-end 向けの product launch も同時に告知しています

About uspage では、Anshul Sadana、Prasad Venugopal、Ryan Torres、Arthi Ayyangar、Ariff Premji らを含む leadership team と board / advisor を公開しています

この snapshot から言えるのは、AI networking の build-out を狙う company として capital と人材を集めているということまでです。一方で、public material だけでは shipment volume、design win の広がり、継続運用実績までは確定できません。したがって、「次の Arista か」という問いに public source だけで断定的に答えるのは避けるべきです。

言い換えると、公開資料から確認できるのは次の水準です。

- hyperscaler / neocloud 向けという target は一貫している

- team は hyperscale networking の経験者を前面に出している

- product と architecture の主張はかなり具体化されている

逆に、顧客別の採用規模や competitive displacement を読み切るには、public material だけでは足りません。

どんな operator が検討対象にしやすいか

Nexthop AI の公開資料を前提にすると、検討対象になりやすいのは次のようなケースです。

1. 自前の NOS / automation を活かしたい

SONiC や FBOSS を軸に network stack を持っているなら、Nexthop AI の訴求点は分かりやすいです。hardware と optics validation を vendor に寄せながら、software ownership は自社に残せます。

2. scale-across 設計が cluster 内 fabric より重要

単一 cluster の leaf/spine だけでなく、cluster 間接続、DCI、long-reach optics が設計課題なら、5000 Series と Disaggregated Spine の主張は検討価値があります。

3. power / thermal / optics を network 側でも詰めたい

Platforms page は throughput だけでなく thermal footprint、LPO / LRO、real-time telemetry を前面に出しています。GPU 側の熱と電力だけでなく、network 側の headroom まで最適化したい案件とは相性があります。

反対に、汎用ネットワーク刷新や campus switching のような文脈では、公開資料の主戦場とズレやすいです。

導入前に確認したいこと

最後に、Nexthop AI を記事として読むより、実際の導入候補として扱うなら先に確認したい点をまとめます。

-

どの network 層を任せるのか scale-out、scale-across、front-end を一社にまとめるのか、層ごとに vendor を分けるのか。

-

NOS の ownership は誰が持つのか SONiC / FBOSS / BYoNOS を自社で回すのか、Nexthop NOS を使うのか。

-

optics qualification を誰が担うのか LPO / LRO / ZR を含め、障害切り分けと相互接続試験の責任境界を明確にする。

-

thermal と power の前提は何か public benchmark は参考になるが、自社ラック、airflow、oversubscription、traffic pattern で再計算が必要。

-

custom engineering の範囲はどこまでか off-the-shelf で足りるのか、JDM 的に寄せるのかで lead time と運用負荷が変わる。

まとめ

Nexthop AI を public material ベースで読むと、「巨額調達をした新興企業」よりも、AI/Cloud networking を層別に分けて設計し、open NOS と custom engineering を前提に製品化する company として捉える方が実像に近いです。

特に重要なのは、4000 / 4200 / 5000 Series という hardware の違いそのものより、どの network 層を担い、どの NOS を回し、どこまで optics / telemetry / validation を vendor に任せるかという運用境界です。

Nexthop AI が長期的にどこまで伸びるかは public source だけでは断定できません。ただ、公開資料の時点でも、AI cluster 向け networking を product、software、architecture の 3 面で組み立てようとしていることは明確です。導入判断では、headline の大きさより、自社の fabric 設計と ownership model に合うかを優先して読むのが実務的です。

公式リソース

- Nexthop AI Platforms

- Nexthop AI About Us / Team

- Nexthop AI product press release

- Nexthop AI company launch press release

- Nexthop AI Series B press release

- Disaggregated Spine for Modern AI Networks

- NH-5000 Series Datasheet

本記事はネクサフローのAI研究シリーズの一部です。

この記事の著者

中村 知良

代表取締役

早稲田大学卒業後、ソフトバンク株式会社にてAI活用やCEO直下案件のプロジェクトマネージャーに従事。その後、不動産スタートアップPit in株式会社の創業、他スタートアップでの業務改善・データ活用を経験後、2023年10月、株式会社ネクサフローを創業し代表取締役CEO就任。

次に読む

あわせて読みたい

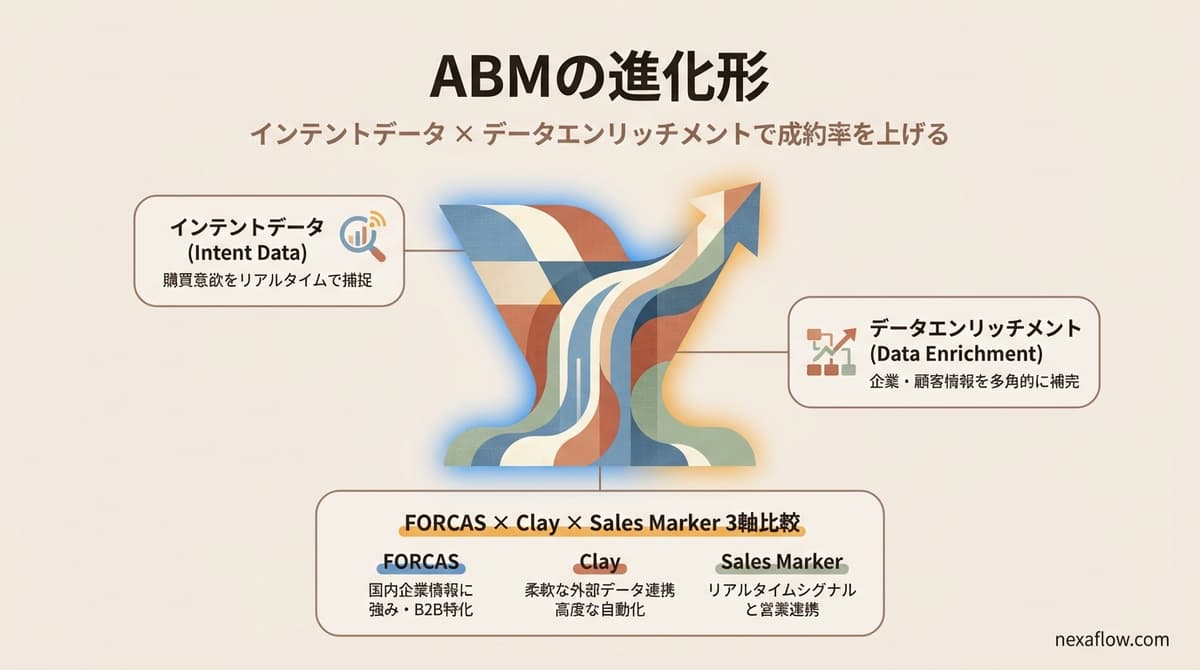

ABMの進化形——インテントデータ×データエンリッチメントの設計メモ

ABMが静的なターゲットリストで止まる理由を整理し、インテントデータ、データエンリッチメント、Data Waterfall、Signal-based sellingを組み合わせて営業とマーケの動きを設計するための読み筋をまとめる。

2026/04/15

ABMインテントデータデータエンリッチメント

日本のBtoB営業はなぜ「顧問頼み」なのか?データ×関係性のハイブリッドGTM

CPC¥10,403——顧問営業はなぜこれほど高単価なのか。LinkedIn不在・信頼文化という日本固有の構造を解明し、データで的を絞り、顧問で接点を作る「ハイブリッドGTM」の設計方法を解説する。

顧問営業GTM

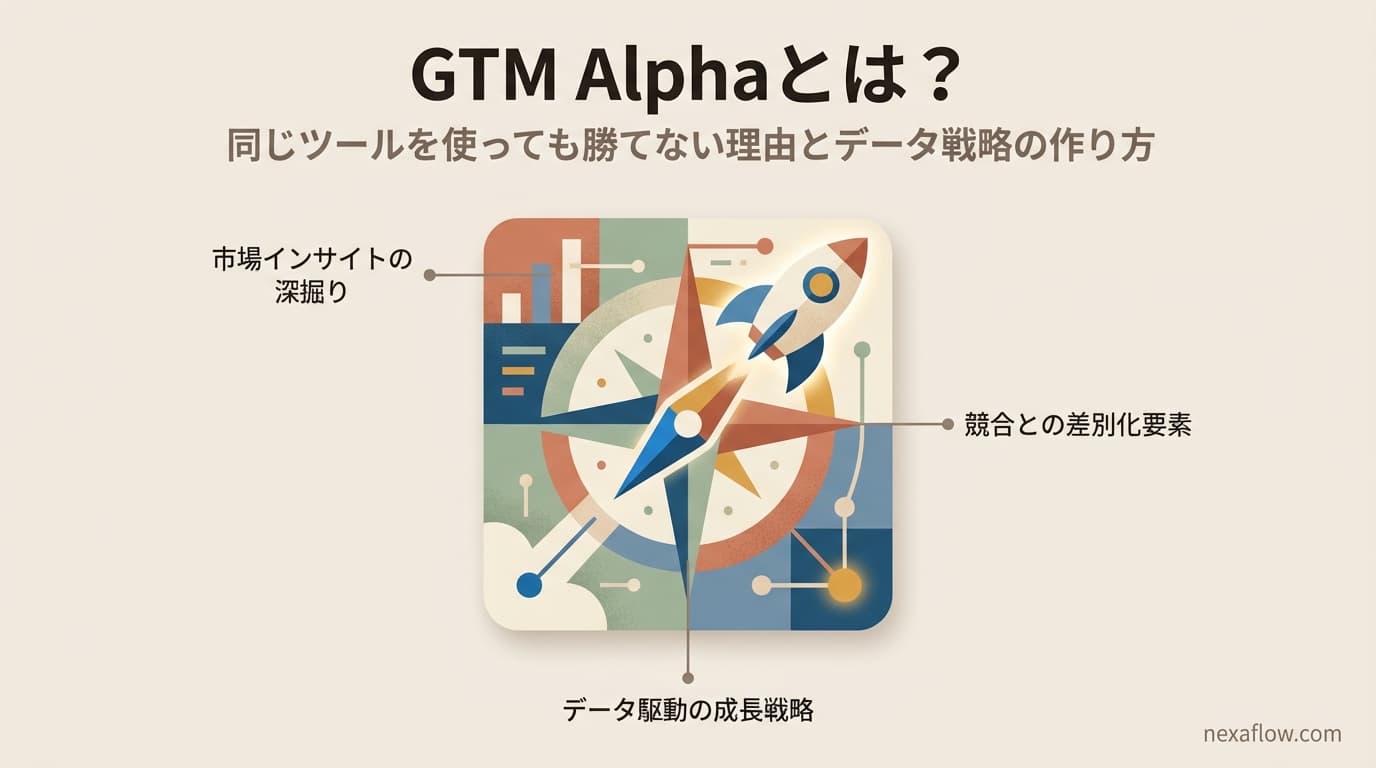

GTM Alphaとは?同じツールを使っても勝てない理由とデータ戦略の作り方

GTM Alpha(GTMアルファ)とは、競合が持たないデータを活用し、競合ができない施策を実行することで得られる営業上の競争優位性である。金融用語のα(超過リターン)から転用されたこの概念を、GTMの3法則・日本市場のデータソース・実装ロードマップとともに解説する。

GTM AlphaGTM戦略