対談・インタビュー

DeepMindとSergey BrinのAGI timelineを読む|Big Technology対談 recap

8分で読める|2026/04/15|

AIDeepMindインタビュー

この記事の要約

Big Technology Podcast の対談を、2030という年号そのものよりも、AGIの定義、reasoningに時間をかける発想、physical context を扱う assistant、SynthID の論点から読み解く

この対談を記事として残す価値は、AGI の年当てより 何を AGI とみなすか にあります。

Demis Hassabis と Sergey Brin のやり取りでは、2030 前後という timeline が目を引きます。ただ、本文で残したいのは年号そのものではありません。consistency の定義、reasoning に計算資源を振る発想、physical context を理解する assistant、AI 生成物の識別という論点です。

この記事の位置づけ

- 元ソースは Big Technology Podcast の対談です

- 2030 前後という timeline は、対談当時のスナップショットとして扱います

- 制度や製品仕様は変わりやすいため、実務に使う前に公式資料を確認してください

この記事でわかること

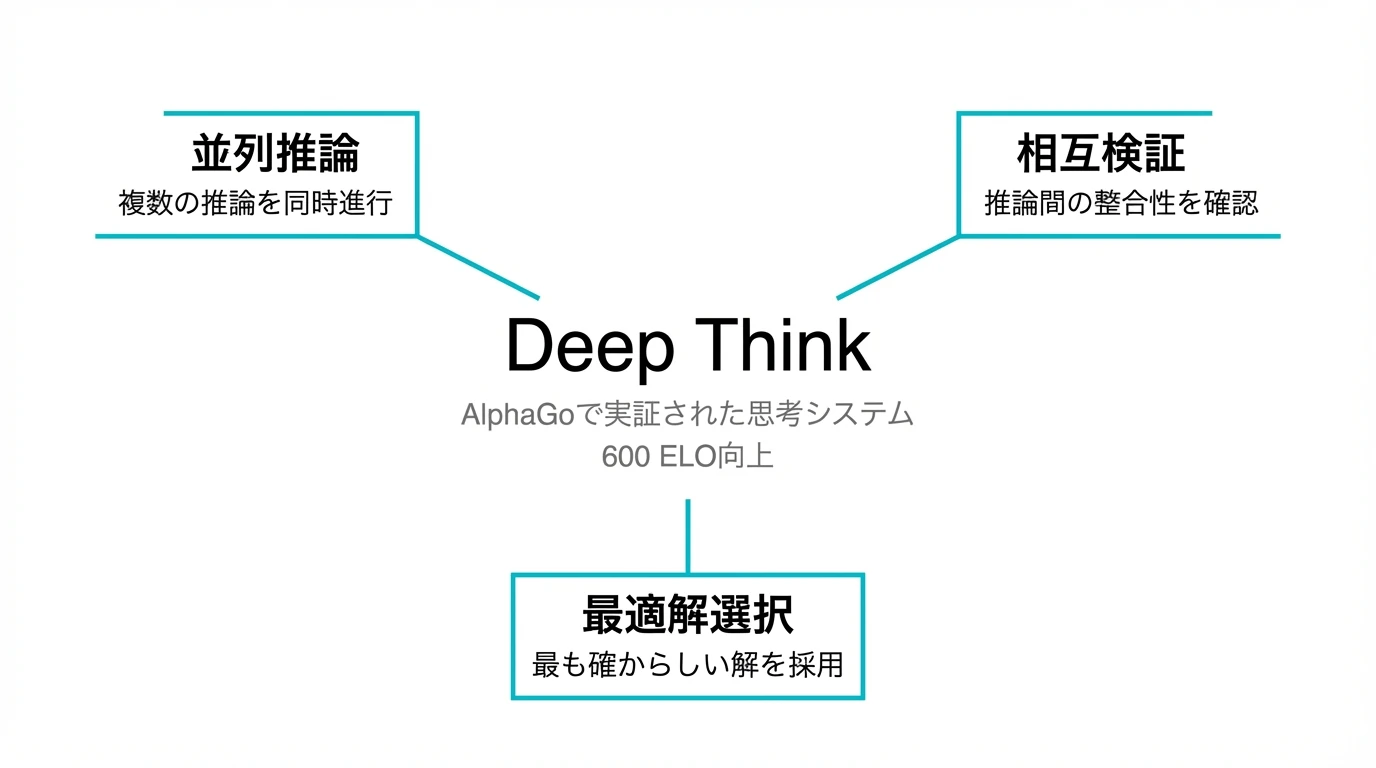

- Demis Hassabis が AGI を

穴を見つけにくい一貫性で捉えていた点 - Deep Think を

考える時間を増やす reasoningとしてどう説明していたか - Sergey Brin が scaling 一辺倒ではなく algorithm の工夫を重視した理由

- multimodal assistant と smart glasses をどう結びつけていたか

- SynthID を

AI生成物を見分ける仕組みとしてどう位置づけていたか

基本情報

| 項目 | 内容 |

|---|---|

| ソース | Big Technology Podcast の対談 |

| 登壇者 | Demis Hassabis、Sergey Brin、Alex Kantrowitz |

| 主題 | AGI timeline、reasoning、multimodal assistant、SynthID |

| 読み方 | 将来を断定する記事ではなく、対談で残る論点メモとして読む |

| 読了時間 | 10-12分 |

1. AGI を年号ではなく consistency で見る

Hassabis が置いていた基準は、単に多くの問題を解けることではありません。専門家が簡単には穴を見つけられないほど、広い領域で一貫して振る舞えることでした。

"For something to be called AGI, it would need to be consistent, much more consistent across the board than it is today. It should take like a couple of months for a team of experts to find a hole in it."

記事として残したいのは、この 数分で崩れるものでは足りない という感覚です。timeline の話も、この定義を置いたうえで読んだ方が意味が通ります。

対談のなかでの timeline

直接の問いに対して、2人は次の幅で答えていました。

| 話者 | timeline のニュアンス |

|---|---|

| Sergey Brin | before 2030 |

| Demis Hassabis | just after 2030 |

重要なのは年号を固定値として受け取ることではなく、2人とも まだ数段のブレークスルーが要る という前提を崩していない点です。

2. scaling と algorithm の両方が要るという見方

対談の前半で印象的なのは、計算資源を増やせばそれで終わり というトーンではなかったことです。Hassabis は追加のブレークスルーが要ると話し、Brin は天体シミュレーションのような例を引きながら、algorithm の工夫が大きく効く場面を挙げています。

この対比から読めるのは次の3点です。

- scaling は frontier を押し広げる

- algorithm の改善は、同じ資源でもできることを増やす

- AGI を論じるなら、計算量と発想転換の両方を見る必要がある

AI 記事は モデルが巨大化した という説明に寄りがちですが、この対談では どう考えさせるか も同じくらい重視されていました。

3. Deep Think を 長く考えさせる reasoning として読む

技術論点の中心は Deep Think でした。ここでの記事上の読み方はシンプルです。高価値の問いに対して、AI により長い reasoning budget を与える発想だと捉えると理解しやすくなります。

Hassabis は AlphaGo の例を使い、thinking を切った版と入れた版で 600 ELO 以上の差が出たと説明しました。

| モード | 対談中の説明 |

|---|---|

| 思考なし | master level に近い |

| 思考あり | world champion を超える |

この話を 囲碁の特殊事情 で終わらせるのはもったいありません。対談全体での含意は、すぐ返す より 時間を使って絞り込む 方が向く仕事があるということです。

記事として残るポイント

- reasoning は単発の回答性能だけでなく、探索の深さを変える

- 高難度タスクでは、速さより検討の厚みが価値になる

- AGI 議論でも、単なる巨大化より

思考の回し方が焦点になる

4. multimodal assistant は physical context と一緒に語られていた

対談では、assistant が日常で役立つにはユーザーの physical context を理解する必要がある、という話が出ます。ここで smart glasses や camera を例にしていた点が重要です。

"We want it to be useful in your everyday life for everything. And so it needs to come around with you and understand your physical context."

この発言を記事で残すなら、Google はどの製品が勝つか という競争論ではなく、assistant を単一画面の UI に閉じない発想として読む方が durable です。

Gemini を multimodal-first で置いた意味

Hassabis は、Gemini を最初から multimodal として組み立てた理由を physical context を扱うため と結びつけていました。テキストだけではなく、画像、音声、周辺環境をまとめて理解する assistant を見据えていた、という整理です。

5. Google Glass の話は hardware lesson として読む

対談では Sergey Brin が Google Glass を振り返り、自分たちのミスを率直に認めています。ここで価値があるのは 失敗した製品史 そのものより、wearable AI を考えるときの lesson がまとまっていることです。

Glass から拾える3つの lesson

- 当時は AI 側の能力が弱く、体験全体を支えきれなかった

- consumer hardware の supply chain は software とは別の難しさがある

- partner と一緒に作る設計が重要になる

この整理を置くと、smart glasses の話題も 次に当たるか外れるか ではなく、AI と hardware をどう組み合わせるかのメモとして読めます。

6. SynthID は AI生成物を見分ける仕組み として押さえる

対談の終盤では SynthID も話題になります。Hassabis の説明では、生成モデルに invisible watermark を付け、AI生成物を見分けやすくする狙いがありました。

"All of our generative models, we attach SynthID to them. So there's this invisible AI-generated watermark."

ここで大事なのは、coverage や deployment 状況の数字よりも、次の問いです。

- AI生成物をどう識別するか

- 学習データへ再流入する生成物をどう扱うか

- 誤情報やディープフェイクの検知と、配布面の責任をどうつなぐか

実務では、SynthID の適用範囲や仕様をそのままこの記事から判断せず、公式ドキュメントで確認する前提が安全です。

7. シミュレーション仮説のやり取りは 世界観 の違いとして読む

対談の最後には、Hassabis のツイートをきっかけにシミュレーション仮説の話も出ます。ここは AGI の実務論からは少し外れますが、2人の思考の置き方が見える場面です。

- Hassabis は宇宙を information-theoretic に見る感覚を示しつつ、単純な simulation だとは言わない

- Brin は

無限の入れ子になるのではという論理面の違和感を指摘する

この掛け合いは、AI 研究者と創業者がどこまで抽象度を上げて世界を語るかの温度差として読むと面白いです。

日本企業への示唆

この対談を日本の事業文脈で読むなら、使いやすい論点は次の3つです。

consistency

AI の評価を、単発の正答率だけでなく どのくらい崩れにくいか で見る視点です。社内導入でも、派手なデモより failure mode の洗い出しが先に来ます。

reasoning budget

高単価の業務では、即答より 長く考えさせる 方が価値になるケースがあります。調査、設計、承認前レビューでは特に有効です。

physical context

assistant を chat UI の中だけで捉えず、camera、voice、wearable、現場作業の文脈まで広げて考える必要があります。ソフトだけでなく hardware 側の難しさも同時に見なければなりません。

よくある質問(FAQ)

Q1. この対談で AGI timeline はどう語られていた?

Sergey Brin は before 2030、Demis Hassabis は just after 2030 という幅で答えていました。ただし、この記事で重視しているのは年号そのものより どの条件を満たせば AGI と呼べるか です。

Q2. Deep Think はどう理解すればいい?

この記事では、考える時間を増やして候補を絞る reasoning という読み方を採っています。AlphaGo の例は、その発想が探索の深さを大きく変えることを示す補助線です。

Q3. Sergey Brin の発言で何が印象的だった?

computer scientist should not be retired right now という言い方です。AI を単なる新機能ではなく、技術転換の中心課題として見ている温度感がよく出ています。

Q4. この対談を実務でどう使えばいい?

モデル名の勝敗予想としてではなく、consistency / reasoning / multimodal / watermarking の論点整理として使うのが安全です。製品の配布範囲や制度面は別途公式資料を確認してください。

Q5. SynthID の扱いで気をつけることは?

記事中の説明だけで coverage を断定しないことです。識別の考え方を掴む入口として読み、運用条件や仕様は公式ページで確認するのがよいです。

まとめ

この対談は、AGI が何年に来るかを断言するための材料というより、AGI をどう定義し、どう近づけようとしているか を見る材料です。

主要ポイント

- timeline の話は

consistencyの定義とセットで読むべき - Deep Think の核心は、reasoning に時間を使う価値がある仕事を見極めること

- multimodal assistant、smart glasses、SynthID は、AI を画面内だけで完結させない視点につながっている

次に見るとよいもの

- AlphaGo 系の論文と、探索を深くしたときの差分

- multimodal assistant を扱う公式デモや製品資料

- AI生成物の識別まわりの公式ドキュメント

関連記事

参考リソース

この記事の著者

中村 知良

代表取締役

早稲田大学卒業後、ソフトバンク株式会社にてAI活用やCEO直下案件のプロジェクトマネージャーに従事。その後、不動産スタートアップPit in株式会社の創業、他スタートアップでの業務改善・データ活用を経験後、2023年10月、株式会社ネクサフローを創業し代表取締役CEO就任。

次に読む

あわせて読みたい

Jensen Huang インタビューから読む AIファクトリーと物理AIの見方

All-In Podcast での Jensen Huang の発言をもとに、AIファクトリー、エージェント、physical AI、社会受容をどう読むか整理します。大きな数字より、設計判断に残る論点へ引き直した interview guide です。

2026/04/15

NVIDIAAIジェンセン・フアン

NVIDIA基調講演から読むAIインフラ設計の論点

Jensen HuangのGTC keynoteをもとに、AIインフラ競争を読むときの判断軸を整理します。需要の積み上がり方、推論フローの分離、ソフトウェア層の役割、ロードマップの見方を講演ベースで読み解きます。

NVIDIAGTC

Ramp CEO Eric Glyman × Stripe対談: AI時代の支出 workflow を読む

Eric Glyman が Stripe Sessions で語った「時間を売る」「経費ポリシーは文化」「ダークマター・モート」を、動画と Ramp の公式 product pages をもとに読み直します。

AIRamp